Odporność w cyfrowym świecie

Pracownicy używają ChatGPT poza kontrolą firm. Problem shadow AI narasta

Coraz więcej pracowników korzysta z narzędzi sztucznej inteligencji bez wiedzy pracodawców. Zjawisko tzw. shadow AI przestaje być wyjątkiem, a staje się normą – niosąc ze sobą poważne ryzyka dla bezpieczeństwa danych, zgodności z przepisami i ciągłości działania firm.

Z tego artykułu dowiesz się…

- Dlaczego coraz więcej pracowników – w tym personel medyczny – korzysta z narzędzi AI poza kontrolą swoich organizacji

- Jakie zagrożenia niesie shadow AI – od wycieków danych po konsekwencje prawne i finansowe – oraz dlaczego problem rozwija się często niezauważenie

- Jak firmy mogą odzyskać kontrolę nad wykorzystaniem

AIi dlaczego edukacja pracowników bywa skuteczniejsza niż zakazy

Nawet 40 proc. brytyjskiego personelu medycznego korzysta z narzędzi generatywnej sztucznej inteligencji w sposób nieautoryzowany – wynika z badania Wolters Kluwer Health opublikowanego w styczniu 2026 r. Chodzi m.in. o wykorzystywanie takich narzędzi jak ChatGPT czy Claude do analizy danych medycznych pacjentów.

Problem nie dotyczy wyłącznie sektora ochrony zdrowia. Badania przeprowadzone przez Microsoft na szerszej grupie pracowników w Wielkiej Brytanii pokazują, że aż 71 proc. osób korzystało z narzędzi AI niezatwierdzonych przez pracodawcę. Ponad połowa robi to co najmniej raz w tygodniu.

To zjawisko określane mianem shadow AI – jedno z najpoważniejszych wyzwań dla cyberbezpieczeństwa w biznesie.

Co się dzieje ze sztuczną inteligencją?

Dane Microsoftu dla rynku brytyjskiego wpisują się w szerszy trend widoczny w innych raportach. Przykładowo, firma Blackfog wskazuje, że niemal połowa pracowników korzysta z narzędzi AI niezatwierdzonych przez pracodawcę.

Zjawisko to nie musi wynikać z intencji omijania zasad. Z danych IBM wynika, że 63 proc. organizacji nie posiada jasnych, wewnętrznych regulacji dotyczących korzystania ze sztucznej inteligencji. To element szerszego problemu, jakim jest tzw. higiena pracy w świecie cyfrowym – obszaru, w którym wciąż brakuje spójnych standardów.

Shadow AI i cienie technologii

Shadow AI to korzystanie z narzędzi sztucznej inteligencji poza formalnymi mechanizmami kontroli w organizacji. Takie rozwiązania nie przechodzą oceny ryzyka, brakuje weryfikacji dostawców, a zasady przetwarzania danych pozostają niejasne lub nie istnieją.

– Firmy boją się hakerów z Rosji, a shadow AI siedzi w ich open space, pije kawę i właśnie wkleja umowę do ChatGPT. To dobrze pokazuje skalę problemu. Największe ryzyko nie wynika dziś z ataków z zewnątrz, lecz z niekontrolowanego użycia AI wewnątrz organizacji – komentuje Dawid Szajner, specjalista w obszarze AI.

Firmy boją się hakerów z Rosji, a shadow AI siedzi w ich open space, pije kawę i właśnie wkleja umowę do ChatGPT. To dobrze pokazuje skalę problemu.

Jak zaznacza, w praktyce shadow AI oznacza, że pracownicy sięgają po narzędzia najwygodniejsze i najszybciej dostępne. Często nie mają świadomości, że do modeli trafiają umowy, dane klientów czy inne informacje – w tym objęte tajemnicą handlową.

– W efekcie każdy pracuje według własnych zasad, co prowadzi do chaosu i utraty kontroli nad tym, jakie dane opuszczają organizację. Zamiast zakazów potrzebne są proste ramy – choćby lista dopuszczonych narzędzi, wykluczenie wrażliwych danych oraz regularna edukacja zespołu. W większych firmach warto wdrożyć także rozwiązania klasy DLP, które monitorują i blokują nieautoryzowany przepływ danych – dodaje ekspert.

Komentarz partnera cyklu

Rozwaga, uprawnienia i wiedza

Ważny jest wybór modelu – jeśli to publiczne API, kluczowym punktem będzie analiza ryzyka w kontekście danych, jeśli lokalny – to model musi pochodzić z zaufanego źródła, być sprawdzony i przetestowany przed użyciem.

Kolejny priorytet to uprawnienia, z jednej strony te dotyczące danych jakie chcemy przetwarzać i z których AI może korzystać, z drugiej kto i w jakim zakresie może korzystać ze zbudowanego rozwiązania. Na przykład asystent AI, który ma dostęp do systemu kadrowego nie może dawać dostępu do danych pracownikowi, do których normalnie nie miałby dostępu (np. do wynagrodzenia kolegi czy jego danych osobowych).

Bez względu na to jakie rozwiązania budujemy czy mowa „jedynie” o dostępie do czatów czy agentów AI na służbowych komputerach, bardzo ważna jest edukacja i dostarczenie niezbędnej wiedzy do bezpiecznego korzystania z tych rozwiązań – wtedy zapewnią firmie realny zysk a nie incydent.

Co generuje shadow AI?

Tego typu wykorzystanie narzędzi AI jest wysoce problematyczne. Nawet przy zachowaniu ostrożności.

– Brak jasnych zasad bardzo szybko przekłada się na realne ryzyka – od wycieków danych i utraty przewagi konkurencyjnej po konsekwencje prawne, np. związane z RODO. Dane mogą zostać wykorzystane poza firmą lub posłużyć do trenowania modeli. Pracowaliśmy z e-commerce generującym ponad 100 mln zł rocznie, który przez jeden nieautoryzowany program zainstalowany przez pracownika stracił dostęp do całej platformy sprzedażowej. Firma praktycznie przestała działać, a jedynym wyjściem była zapłata okupu. Dlatego pytanie nie brzmi dziś „czy to nas dotyczy”, lecz „co możemy zrobić, aby odzyskać kontrolę” – komentuje Dawid Szajner.

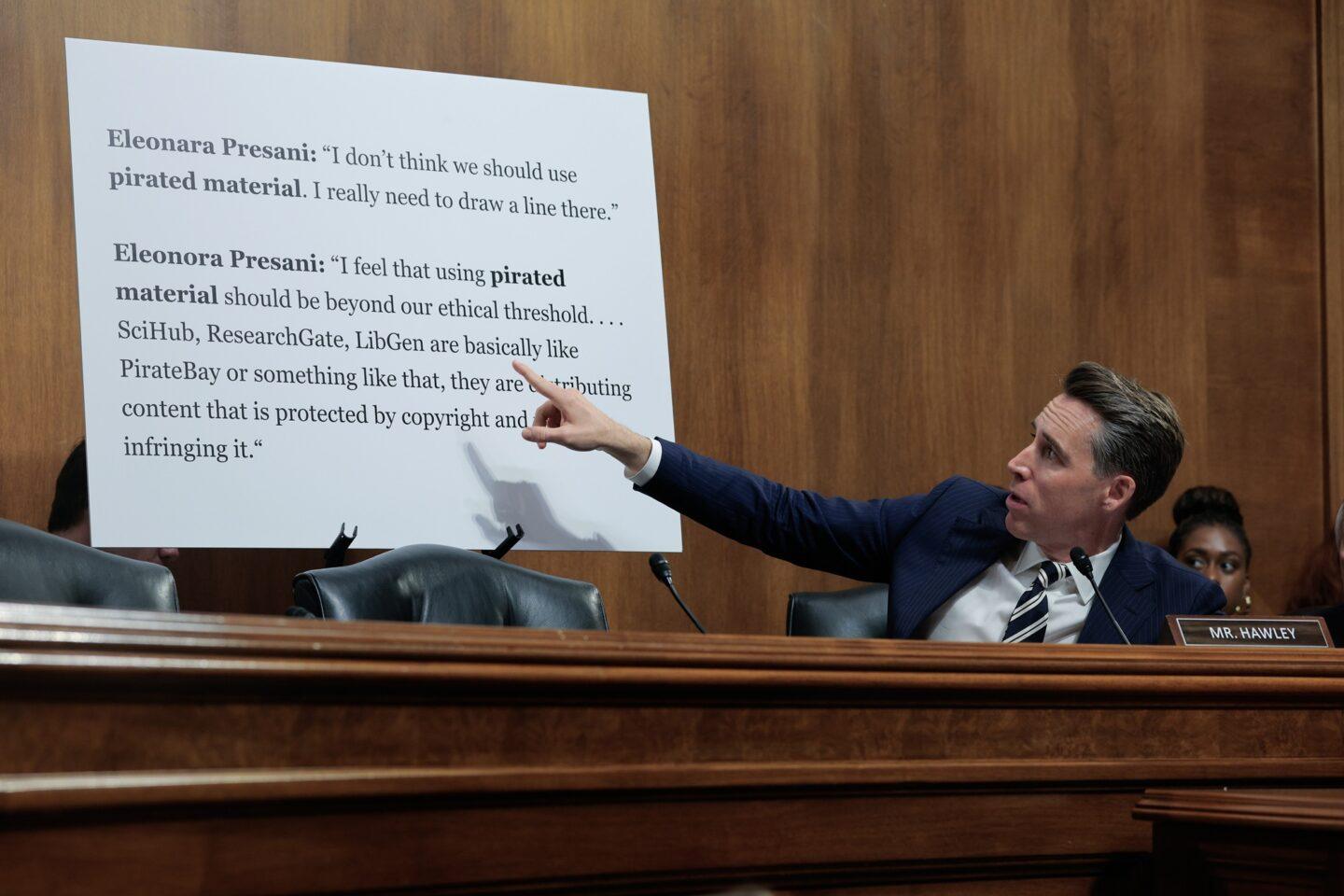

Przykłady negatywnych konsekwencji można mnożyć. Już w 2023 r. zakaz korzystania z ChatGPT wprowadził Samsung Electronics – po tym, jak jeden z pracowników wgrał do narzędzia kod objęty tajemnicą. Na podobny krok zdecydował się także Apple, choć w tym przypadku chodziło o działania prewencyjne i obawy przed potencjalnym wyciekiem danych.

Wspólnym mianownikiem tych sytuacji jest brak bezpiecznej alternatywy wewnątrz organizacji.

Jak naprawić sytuację?

O możliwych rozwiązaniach mówi Ewa Chamczyk, ekspertka w obszarze AI.

– Zakazy nie działają – podkreśla.

Skuteczniejsze okazuje się podejście odwrotne, czyli wdrażanie narzędzi AI klasy enterprise.

– To rozwiązania, w których dane firmowe nie są wykorzystywane do trenowania modeli. Organizacje inwestują w szkolenia – firmy z programami edukacyjnymi notują nawet 40 proc. mniej incydentów bezpieczeństwa. Budują też struktury governance: międzyfunkcyjne rady ds. AI klasyfikują narzędzia na zatwierdzone, ograniczone i zabronione, tworzą sandboxy do testów na zanonimizowanych danych, szybkie ścieżki akceptacji oraz wewnętrzne platformy typu „AI App Store”. To jednak nie zadziała bez jednego elementu – kultury organizacyjnej, w której przyznanie się do korzystania z AI nie kończy się sankcją – zaznacza Ewa Chamczyk.

Ekspertka przywołuje także konkretny przykład.

– W maju 2023 r. ujawniono, że lekarze w szpitalu w australijskim Perth wpisywali do publicznego ChatGPT dane pacjentów – w tym imiona i diagnozy – aby przyspieszyć tworzenie dokumentacji medycznej. Działania te nie były w żaden sposób nadzorowane, a sprawa wyszła na jaw dopiero po fakcie. W konsekwencji cała sieć szpitalna została zmuszona do natychmiastowego zakazu korzystania z narzędzi AI – komentuje nasza rozmówczyni.

Warto wiedzieć

Kilka zasad do zastosowania w firmie

- Stosuj bezpieczne prompty – bez informacji, które nie powinny trafić do przestrzeni publicznej.

- Dane wrażliwe wprowadzaj do narzędzi AI wyłącznie wtedy, gdy masz pewność, że korzystasz z rozwiązania klasy enterprise z kontrolą retencji danych.

- Wprowadź czteropoziomową klasyfikację informacji wykorzystywanych w AI:

- informacje jawne – bez ograniczeń

- informacje wewnętrzne – do użycia po odpowiedniej anonimizacji

- informacje poufne – wyłącznie w ściśle kontrolowanych środowiskach

- informacje regulowane – zakaz użycia AI bez formalnej oceny ryzyka

- Jako pracodawca bądź otwarty na potrzeby pracowników i wdrażaj zaufane narzędzia AI tam, gdzie przynoszą realne korzyści.

Zakazy to błąd. Rozwiązaniem jest edukacja

Podobne podejście prezentuje Marcin Dąbrowski, dyrektor ds. sztucznej inteligencji w 3SOFT oraz właściciel produktu w projekcie Obywatel Bielik.

– Pierwszym odruchem wielu firm po odkryciu shadow AI jest zakaz. To błąd – zazwyczaj powoduje, że problem schodzi głębiej w cień i staje się trudniejszy do zarządzania. Zagrożenia są realne: wycieki danych, naruszenia RODO, ryzyko dla tajemnic handlowych, a w branżach regulowanych także konsekwencje compliance. Widziałem to w praktyce – firma zgłasza się po wdrożenie AI, a okazuje się, że połowa zespołu korzysta z niej już od miesięcy, bez wiedzy organizacji. Nikt nie ustalił zasad, więc każdy robił to na własną rękę – mówi ekspert.

Jak podkreśla, skuteczna odpowiedź zaczyna się od edukacji, a nie od regulaminów.

– Sama edukacja jednak nie wystarczy. Musi iść w parze z dostarczaniem pracownikom bezpiecznych, zatwierdzonych narzędzi. Pracownicy sięgają po własne rozwiązania, bo nie dostają lepszej alternatywy. Z raportu Microsoftu i LinkedIn Work Trend Index, obejmującego 31 tys. pracowników w 31 krajach, wynika, że 78 proc. osób korzystających z AI przynosi własne narzędzia do pracy, a jedynie 39 proc. otrzymało jakiekolwiek szkolenie od pracodawcy. Problem nie leży w ludziach, lecz w organizacjach, które nie zapewniają im wiedzy ani bezpiecznych narzędzi – dodaje Marcin Dąbrowski.

Programy edukacyjne powinny obejmować m.in. wyjaśnienie, w jaki sposób narzędzia AI przetwarzają dane oraz jakie ryzyka może nieść nawet pozornie niewinny prompt.

– To buduje coś cenniejszego niż sama polityka bezpieczeństwa – świadomego pracownika. A świadomy pracownik nie potrzebuje zakazów, by wiedzieć, gdzie kończy się bezpieczeństwo firmy, a zaczyna się ryzyko – podsumowuje Marcin Dąbrowski.

Skończmy z YOLO mode. Szczególnie przy agentach AI

Shadow AI może generować poważne ryzyka, zwłaszcza w dużych organizacjach – tam, gdzie nadzór nad pracą jest ograniczony, a przepływ informacji pozostawia wiele do życzenia. Szczególnie wrażliwym obszarem pozostaje wykorzystanie sztucznej inteligencji przez programistów, zwłaszcza bez odpowiedniego nadzoru i przy braku właściwej higieny pracy.

– Największe ryzyka to przede wszystkim wycieki danych, np. zmiennych środowiskowych (env), które mogą zostać nieświadomie ujawnione podczas pracy z AI. Widzimy też problem niekontrolowanego użycia zaawansowanych modeli z dostępem do infrastruktury. To może prowadzić do błędów w kodzie, podatności, a nawet incydentów w środowisku produkcyjnym – mówi Aleksander Surynau, twórca startupów Amibudget.app i essa.app.

Jak podkreśla, dobre praktyki obejmują m.in. kontrolę jakości kodu przez doświadczonych programistów, przechowywanie wrażliwych danych poza repozytoriami (np. w systemach CI/CD), ograniczanie dostępu AI do infrastruktury oraz korzystanie z modeli lokalnych tam, gdzie to możliwe.

– Kluczowe jest także unikanie korzystania z autonomicznych agentów bez nadzoru, czyli tzw. YOLO mode. Szczególnie w sytuacjach, gdy AI samodzielnie pisze kod, wdraża go, a następnie wprowadza zmiany w bazie danych bez jakiejkolwiek kontroli ze strony człowieka – dodaje nasz rozmówca.

Główne wnioski

- Shadow AI stało się powszechną praktyką w wielu organizacjach. Dane pokazują, że zarówno w sektorze medycznym, jak i wśród ogółu pracowników w Wielkiej Brytanii, znaczna część osób korzysta z narzędzi sztucznej inteligencji bez wiedzy i zgody pracodawców. Zjawisko to nie wynika wyłącznie ze złej woli pracowników, lecz często z braku jasnych zasad oraz niedostatecznego wsparcia ze strony organizacji. W efekcie pracownicy samodzielnie sięgają po dostępne rozwiązania, co prowadzi do utraty kontroli nad przepływem danych.

- Niekontrolowane użycie AI generuje realne i wielowymiarowe ryzyka dla firm. Obejmują one nie tylko potencjalne wycieki danych czy naruszenia przepisów, takich jak RODO, ale także utratę przewagi konkurencyjnej oraz poważne incydenty operacyjne – w skrajnych przypadkach prowadzące do paraliżu działalności przedsiębiorstwa. Szczególnie niebezpieczne jest nieświadome przekazywanie wrażliwych informacji do zewnętrznych modeli AI oraz brak kontroli nad dalszym wykorzystaniem tych danych.

- Eksperci zgodnie wskazują, że same zakazy są nieskuteczne i mogą pogłębiać problem. Skuteczniejsze okazuje się wdrażanie bezpiecznych narzędzi klasy enterprise, tworzenie jasnych zasad korzystania z AI oraz inwestowanie w edukację pracowników. Kluczowe znaczenie ma również budowanie kultury organizacyjnej – opartej na zaufaniu i świadomości – w której pracownicy rozumieją ryzyka i potrafią odpowiedzialnie korzystać z nowych technologii.