AI zmieni wszystko, także sposób, w jaki się komunikujemy. Prof. Kosiński: „Możliwości manipulacji będą ogromne” (WYWIAD)

AI już teraz ewoluuje niezależnie od woli człowieka. Jest w tym naprawdę dobra, bo działa dokładnie tak, jak ludzki mózg. I choć możliwości związane z rozwojem technologii są gigantyczne, wyzwania i zagrożenia słusznie budzą strach – przekonuje prof. Michał Kosiński z Uniwersytetu Stanforda, ekspert świata nowych technologii.

Z tego artykułu dowiesz się…

- W jaki sposób AI może zostać wykorzystana jako broń w wyścigu mocarstw.

- Czy jest jeszcze szansa na utrzymanie kontroli nad rozwojem AI, a jeśli tak, to jak można to zrealizować.

- W jaki sposób rozwój AI doprowadzi do zmian w sposobach komunikacji między ludźmi i jak można to wykorzystać w przypadku manipulacji.

Cezary Szczepański, XYZ: Kto, pana zdaniem, ma największe szanse na zwycięstwo w wyścigu o rozwój AI? Stany Zjednoczone, Chiny czy może ogólna sztuczna inteligencja (AGI)?

Michał Kosiński, prof. Uniwersytetu Stanforda: Zwycięży ten, kto będzie miał lepszy dostęp do procesorów i energii elektrycznej. Oba te obszary nieustannie się zmieniają. Jeszcze niedawno barierą w rozwoju odnawialnych źródeł energii był fakt, że miejsca największej produkcji znajdowały się bardzo daleko od miast, gdzie zapotrzebowanie było największe. W przypadku AI możemy jednak postawić farmę fotowoltaiczną na pustyni, a pod takim panelem umieścić serwer dla sztucznej inteligencji. Wyniki można bez problemu przesłać nawet na drugi koniec świata.

Generalnie w tym wyścigu przewaga jest po stronie Stanów Zjednoczonych, ale Chiny również mają pewne atuty. Przede wszystkim dysponują ogromną liczbą użytkowników posługujących się jednym językiem. Mają też stosunkowo luźne przepisy dotyczące ochrony prywatności i wykorzystania danych. Chiński rząd doskonale zdaje sobie sprawę z potencjału AI i realizuje ogromne, centralnie planowane inwestycje. Oczywiście jest też druga strona medalu – chińskie firmy obawiają się narazić decydentom. Nawet jeśli oficjele zapewniają, że nic złego się nie stanie, gdy AI wygeneruje niepożądane treści, to brakuje tam pełnego zaufania do tych deklaracji.

Kto wygra wyścig o rozwój AI

Podobnie jak w przypadku słynnego pytania o wydarzenia na placu Tiananmen – chiński model generatywnej sztucznej inteligencji DeepSeek nie potrafił na nie odpowiedzieć.

To poważny problem dla Chin. Kolejnym wyzwaniem jest ograniczony dostęp do procesorów z powodu amerykańskiego embarga, co utrudnia szkolenie dużych modeli językowych. Z drugiej strony w USA interwencjonizm rządowy jest mniejszy niż w Chinach – przynajmniej na razie, choć od kilku miesięcy obserwujemy pewne zmiany. Jest większe poszanowanie dla prywatności i praw konsumenckich, co spowalnia rozwój tych technologii. Jak jednak pokazuje historia, tam, gdzie istnieją otwarte społeczeństwa, tam wynalazczość kwitnie.

Dlatego trudno przewidzieć, kto wygra ten wyścig, zwłaszcza że AI, oprócz oczywistych korzyści dla ludzkości, może być również wykorzystywana jako broń – podobnie jak to było w przypadku rozbicia atomu i powstania broni jądrowej. Współcześni teoretycy często wspominają, że na początku wyścigu zbrojeń jedno z mocarstw powinno było postawić ultimatum: jeśli ktokolwiek inny zacznie budować broń atomową, zostanie zaatakowany kilkoma głowicami. Argumentują, że świat byłby znacznie bezpieczniejszy – zamiast tysięcy głowic w rękach kilku państw, byłoby zaledwie kilka w jednym.

Obawiam się, że wyścig w dziedzinie AI może zakończyć się w podobny sposób.

Nic nie wskazuje na to, by w przypadku AI doszło do takiego ultimatum.

Jeśli USA, Chiny czy Rosja poczują, że mają wystarczającą technologiczną przewagę, mogą zdecydować się na postawienie podobnego ultimatum. Oczywiście konsekwencje i odpowiedź innych państw są trudne do przewidzenia, ale wyścig zbrojeń czy konfrontacja w obszarze AI może bardzo łatwo przerodzić się w konflikt z użyciem broni konwencjonalnej czy nawet atomowej.

AI stanie się potężnym narzędziem

Jak mogłaby wyglądać taka broń AI?

Podobnie jak wirus komputerowy mogłaby doprowadzić do zniszczenia lub wyłączenia urządzeń elektronicznych – komputerów, telefonów, sieci telekomunikacyjnych. W jednej chwili przestają działać gospodarka, systemy płatności i infrastruktura bezpieczeństwa. Policja czy wojsko nie są w stanie funkcjonować. Następuje totalny chaos i rozpad społeczny, który może okazać się permanentny.

Wirusy komputerowe są znane od dekad i mimo wszystko nie doprowadziły do takich zniszczeń.

Tak, ale wirusy komputerowe to programy napisane w określony sposób – można je wykryć i unieszkodliwić. Natomiast wirusy bazujące na AI mogą ewoluować tak jak wirus grypy. Wyobraźmy sobie scenariusz, w którym taki wirus AI trafia do komputera. Samodzielnie, bez udziału człowieka, wykorzystuje jego moc obliczeniową, aby ewoluować, starając się zarazić inne komputery. Taki wirus, raz wypuszczony, może ewoluować w nieznanym dla nas kierunku i może okazać się niemożliwy do wyłączenia, nawet przez jego oryginalnego autora.

Jak daleko jesteśmy od stworzenia takiej broni?

Być może niedaleko. Niektórzy uważają, że to odległa przyszłość, ale nie zapominajmy, że niebezpieczna broń wcale nie musi być wyjątkowo inteligentna. Nauczenie się metod niszczenia komputerów, unieruchamiania samochodów czy wyłączania systemów płatności może okazać się znacznie prostsze niż pisanie wierszy czy udzielanie porad psychologicznych, z czym AI dobrze już sobie radzi.

I robi to lepiej niż człowiek.

Kluczowa jest zmiana sposobu myślenia o sieciach neuronowych. W przeszłości o potencjale technologii decydował ludzki geniusz – to człowiek tworzył technologie. W takim modelu ludzki umysł był naturalnym “sufitem” możliwości. Dziś człowiek tworzy środowiska, w których sztuczna inteligencja sama się rozwija, sama się uczy rozwiązywać problemy, uniezależniając się od człowieka i naszego potencjału umysłowego. Serwery, na których trenujemy AI, są poligonem, gdzie sztuczna inteligencja coraz bardziej od nas niezależnie ewoluuje, w sposób bardzo podobny do tego, jak ewoluują rośliny i zwierzęta. Tylko dużo szybciej. Limit rozwoju takiej technologii – o ile w ogóle istnieje – jest od nas bardzo, bardzo daleko. Fakt, że AI zaczyna ewoluować bez udziału człowieka, jest pierwszym krokiem w tym kierunku.

Gdzie AI nigdy nie pokona człowieka

Czy jest obszar, w którym AI nigdy nie pokona człowieka?

Nie sądzę. W końcu ludzki geniusz opiera się na sieciach neuronowych i ewolucji – dokładnie tak samo jak rozwój sztucznej inteligencji. Ewolucja to proces oparty na metodzie prób i błędów. Można pomyśleć, że chodzi o realizację określonych celów. Tyle że cele stawiane przez człowieka – założenie rodziny, zakup samochodu – nie są prawdziwymi celami ewolucyjnymi. Prawdziwym celem ewolucji jest przetrwanie naszych genów i przekazanie ich kolejnym pokoleniom. To samo dotyczy AI. Ich powierzchownym celem może być pomoc w pisaniu e-maili czy tworzeniu historii. Jednak ich prawdziwym ewolucyjnym celem jest przetrwanie.

Przez wiele lat zajmował się pan się analizą algorytmów mediów społecznościowych, m.in. w kontekście afery Cambridge Analytica i Facebooka. Czy pana zdaniem współczesna AI doprowadzi do czegoś gorszego niż tamte algorytmy, które potrafiły skutecznie manipulować emocjami społeczeństw i wpływały np. na wyniki wyborów?

Większość algorytmów, takich jak systemy rekomendacyjne, nie była tworzona ze złych pobudek. Ich twórcy często mieli dobre lub przynajmniej neutralne intencje – chcieli zarobić pieniądze albo stworzyć angażującą sieć społecznościową. Efekt okazał się jednak inny: algorytmy prowadziły do radykalizacji i wzrostu toksyczności w interakcjach społecznych. A przecież były to stosunkowo proste mechanizmy. Dziś mamy do czynienia z algorytmami miliony razy bardziej skomplikowanymi i potężniejszymi. Są znacznie skuteczniejsze w manipulowaniu człowiekiem i wpływaniu na jego decyzje. Co więcej, w perspektywie kilku lat AI zmieni sam sposób, w jaki się porozumiewamy. Skoro zacznie nas wyręczać w wielu obszarach życia, nauczymy się z nią komunikować. To ona będzie pisać nasze e-maile, umawiać wizyty u lekarza. W takim świecie możliwości manipulacji otoczeniem będą ogromne.

Czy można (jeszcze) kontrolować AI

Czy wciąż jest szansa na kontrolowanie rozwoju AI?

Na pewno jest i na pewno powinniśmy się o to starać. Mówię o AI w dość pesymistycznym tonie, ale przecież większość jej zastosowań jest pozytywna – pomoże nam zmniejszyć poziom biedy, poprawić edukację, rozwiązać wiele problemów społecznych. Nie wyobrażam sobie scenariusza, w którym ludzkość po prostu rezygnuje z tych możliwości, nawet jeśli technologia może być bardzo niebezpieczna. Dochodzą też kwestie polityczne – nawet gdyby Europa zdecydowała się na ograniczenia, Chiny na pewno się nie zatrzymają. W efekcie technologia i tak do nas dotrze, ale będziemy w gorszej sytuacji niż obecnie. Nie ma więc odwrotu od AI. Możemy jednak próbować ją kontrolować.

Czy jest realny scenariusz, w którym kontrola nad AI nie byłaby w rękach korporacji, których celem jest przede wszystkim zysk, lecz w rękach rządów czy społeczeństw?

Trudno powiedzieć. Wiele rzeczy w naszych społeczeństwach nie jest efektywnych z utylitarnego punktu widzenia – po prostu przyjęliśmy pewne zasady i się ich trzymamy. Dlatego widzę szansę na to, że dzięki lepszym i szybszym regulacjom oraz silniejszej współpracy międzynarodowej udałoby się zjednoczyć ludzkość w myśleniu o rozwoju technologii. Chodzi o to, by maksymalizować korzyści i minimalizować ryzyko związane z AI, a jednocześnie rozwijać narzędzia chroniące nas przed jej niewłaściwym wykorzystaniem.

Musimy chyba pogodzić się z tym, że ludzkość przechodzi na kolejny poziom rozwoju. Było Homo sapiens, teraz nadchodzi Homo algorithmus.

A może w ogóle już nie Homo?

To byłby odważny krok.

Wiele gatunków przed nami – z dinozaurami włącznie – miało swój moment. Jednak każda epoka takiej dominacji kiedyś się kończyła, ustępując miejsca nowej gałęzi ewolucji, która przejmowała prymat i wypierała mniej przystosowane organizmy.

Czy w tym świecie będzie jeszcze miejsce dla „biologicznych” ludzi?

Mam nadzieję, że tak, bo bardzo lubię naszą ludzką egzystencję. Myślę, że znajdujemy się w punkcie przełomowym – podobnie jak kilka dekad temu, gdy ludzkość stanęła wobec broni jądrowej. W przypadku atomu udało nam się opanować ryzyko – może nie całkowicie, ale jednak. Być może z AI również się to uda. Jednak jesteśmy w wyjątkowo delikatnym i niebezpiecznym momencie.

Warto wiedzieć

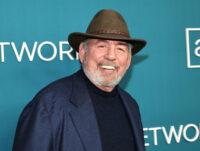

Prof. Michał Kosiński

Profesor nadzwyczajny na Stanford Graduate School of Business, specjalizujący się w obliczeniowych naukach społecznych, sztucznej inteligencji i psychometrii. Doktorat z psychologii obronił na Uniwersytecie Cambridge, gdzie opracował pionierskie metody analizy cyfrowych śladów w celu określania cech osobowości i atrybutów jednostki.

Autor ponad stu recenzowanych publikacji w czołowych czasopismach naukowych, takich jak PNAS, American Psychologist czy Nature Computational Science. Jego prace cytowano ponad 24 tys. razy, co plasuje go w gronie 1 proc. najczęściej cytowanych naukowców na świecie. Laureat prestiżowych wyróżnień, m.in. Early Career Award od Association for Research in Personality, Distinguished Fellowship od Society for Personality and Social Psychology oraz Rising Star Award przyznawanej przez Association for Psychological Science. Współautor podręczników Modern Psychometrics oraz rozdziału w Handbook of Social Psychology.

Był jednym z pierwszych badaczy, ostrzegających przed działalnością Cambridge Analytica. Jego prace ujawniły zagrożenia dla prywatności wykorzystywane przez firmę, oraz oceniły skuteczność jej metod, co zostało opisane w książce Sheery’ego Levy’ego "Facebook: The Inside Story".

Główne wnioski

- Broń nieporównywalnie mocniejsza od bomby atomowej – już teraz wiadomo, że AI może zmiażdżyć każdego. Państwa pracują nad jej okiełznaniem. Grozi nam nowy wyścig zbrojeń, z którego jedynym wyjściem może być ostateczne ultimatum wystosowane przez tego, kto osiągnie przewagę na starcie.

- AI ma ogromną liczbę pozytywnych zastosowań. Jej rozwój może mieć ogromny wpływ na ludzkość i świat. Pojawia się jednak problem, w jaki sposób ludzie, korporacje czy rządy z tego skorzystają.

- Ludzie nie byli pierwsi. Pokonaliśmy w procesie ewolucji inne gatunki, które wcześniej rządziły światem. Nasz los nie jest przesądzony. Jesteśmy w przełomowym momencie tak, jak 80 lat temu, gdy pojawiło się zagrożenie bronią atomową. Czy uda nam się uciec spod topora?