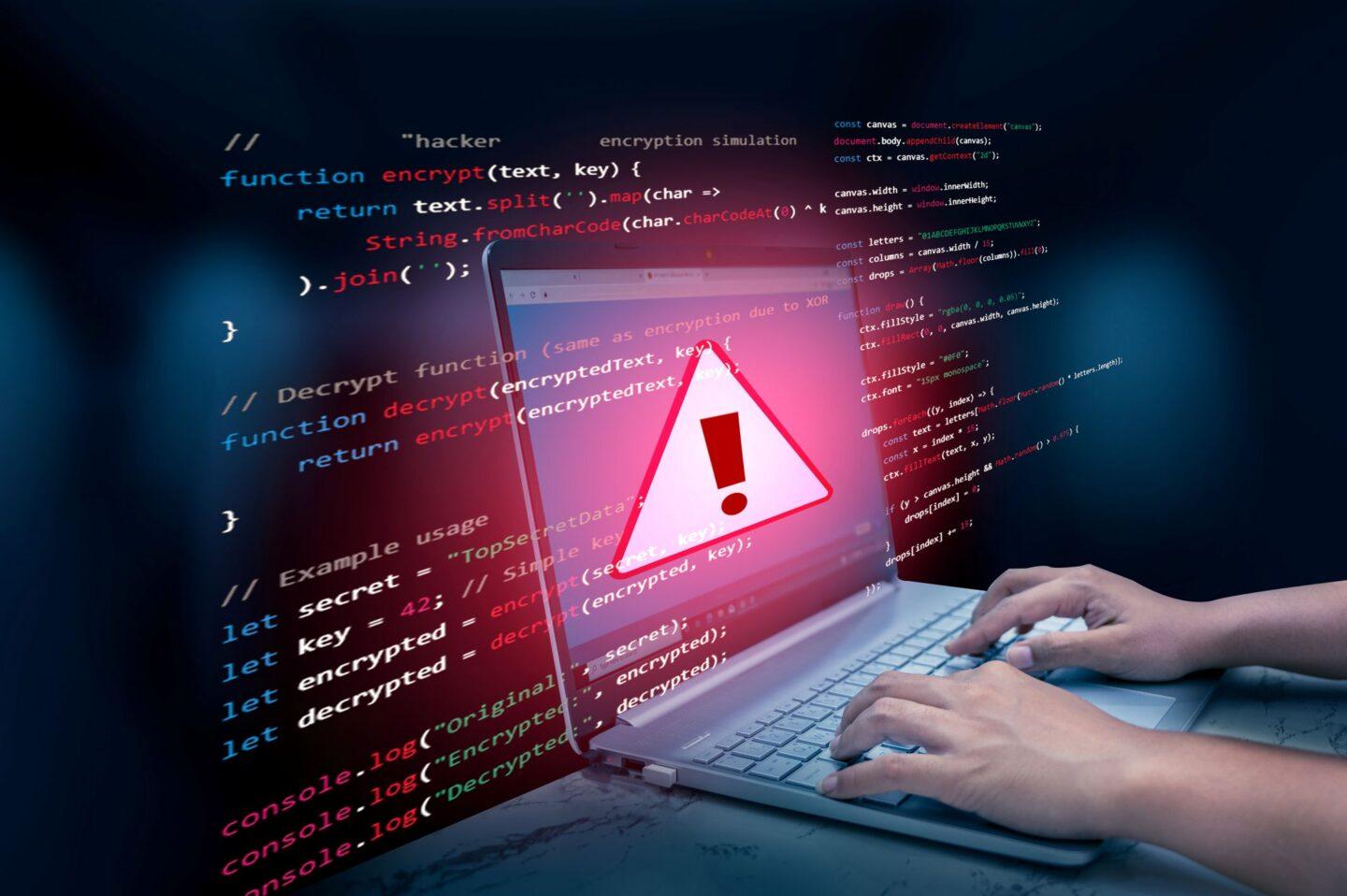

Cyfrowe „Among us", czyli AI w rękach cyberprzestępców

AI jest coraz bardziej wykorzystywana w sieci. Tymczasem to, co ma ułatwić pracę, staje się też wielkim zagrożeniem w rękach przestępców. Nie trzeba już bowiem specjalistycznej wiedzy informatycznej, by przeprowadzić atak. Wystarczy tylko mieć narzędzia, nadzorowane i zaprojektowane przez AI.

Z tego artykułu dowiesz się…

- Jakie będą najpoważniejsze zagrożenia cyberbezpieczeństwa w przyszłym roku.

- Na czym polega rola agentów AI w rękach przestępców.

- Jak AI ułatwi masowe i skoordynowane ataki.

Narzędzia, taktyka i procedury, które kiedyś wymagały skoordynowanego działania całych grup cyberprzestępców, teraz – dzięki AI – mogą być użyte szybko i na dużą skalę – ostrzega Trend Micro w raporcie „AI-fication of cyberthreats”, przedstawiającym prognozy na 2026 r.

AI stała się bowiem podstawą systemów komputerowych wielu firm – od małych przedsiębiorstw po koncerny, gdzie sztuczna inteligencja zarządza produkcją. Niestety ta sama AI przydaje się cyberprzestępcom. Początkowo wykorzystywali ją głównie do tworzenia maili phishingowych. Teraz jednak potrafi skoordynować skomplikowane ataki przy minimalnym nakładzie pracy.

Sytuacji nie pomaga skomplikowanie systemów AI w firmach oraz szybkość rozwoju technologii. Nowoczesny biznes, oparty na platformach cyfrowych czy usługach zewnętrznych, jest coraz bardziej podatny na ataki. Źle skonfigurowany system, zhakowany dostawca czy nawet błąd ludzki może być furtką dla włamywaczy.

Agenci AI w rękach cyberprzestępców

Kolejnym zagrożeniem związanym z agentami są przeglądarki jak Comet od Perplexity, przeglądarka OpenAI czy nowa Opera, które w praktyce działają jak agenci. Przez włamanie do takiej przeglądarki hakerzy będą w stanie wejść do firmowej sieci, przejąć sesję czy podrzucić złośliwy kod. Dlatego takie oprogramowanie powinno być traktowane jako „wysokiego ryzyka”, a najlepiej nie instalować go na sprzęcie służbowym.

Wśród atakujących nie będą tylko ci, którzy liczą na zysk. Ze względu na geopolityczne napięcia i wojny, grupy hakerskie powiązane z państwami mogą brać na cel infrastrukturę krytyczną: energetykę, telekomunikację czy systemy finansowe. Cyberprzestępcy będą chcieli nie tylko zakłócić działanie tych systemów, ale także wykraść informacje oraz technologie.

Deepfake będą jednym z najpoważniejszych zagrożeń

Innym zagrożeniem, przed którym ostrzega Trend Micro, jest gwałtowny wzrost deepfake/deepfakes – obrazów i filmów generowanych przez AI, nie do odróżnienia bez głębokiej analizy. Tanie aplikacje zamieniają dziś zdjęcia z portali społecznościowych w treści seksualizowane. Takie materiały niszczą reputację, prowadzą do szantażu i ośmieszania ofiar. Skutki bywają tragiczne – od załamań psychicznych po samobójstwa. Ponieważ jakość deepfake’ów rośnie, zagrożenie to w 2026 r. ma być jednym z największych niebezpieczeństw czyhających w sieci.

Okazuje się też, że modele AI, które pozwalają nam rozmawiać z cyfrowymi „przyjaciółmi” czy partnerami, również mogą być bronią. Hakerzy tworzą własne modele, którym powierzamy dane, zdjęcia i sekrety – a te są modyfikowane tak, by łatwiej wydobyć od nas informacje.

Zdaniem eksperta

Witajcie w cyberbezpiecznym świecie „Among Us”

Dlaczego analogia do „Among Us” jest dziś tak trafna? Coraz większą popularność zyskuje tzw. vibe coding, czyli poleganie na AI przy tworzeniu kodu aplikacji. Ten trend, choć imponująco wydajny sprzyja powstawaniu licznych podatności – niczym ukrytych pułapek, które czekają, aż ktoś je odkryje i wykorzysta przeciwko nam.

Na pierwszy plan wysuwa się problem zarządzania tożsamością i dostępem w erze Agentic AI. Autonomiczni agenci, którym powierzamy szerokie uprawnienia przez klucze API, zaczynają mieć dostęp do systemów ICT i wrażliwych danych. Gdy taki agent zostanie skompromitowany, w jednej chwili przestaje być pomocnikiem, a staje się cyfrowym impostorem – dokładnie jak w „Among Us”: działa wewnątrz organizacji, wygląda na w pełni uprawnionego, a w rzeczywistości jest sterowany przez cyberprzestępców.

Równolegle widać postępującą industrializację cyberprzestępczości z wykorzystaniem AI. Ataki stają się coraz bardziej zautomatyzowane, lepiej przygotowane i skoordynowane, a przez to trudniejsze do wykrycia klasycznymi mechanizmami obrony. Cyberprzestępcy zyskują potężne narzędzia do masowego wyszukiwania podatności i automatycznej eksploatacji luk, co przekłada się na skalę i tempo kampanii, z którymi tradycyjne zespoły bezpieczeństwa mają coraz większy problem.

Nadchodzący rok, mimo obiecujących perspektyw rozwoju technologii, przyniesie organizacjom bezprecedensowe wyzwania w obszarze cyberbezpieczeństwa. Wymusza to proaktywne podejście do bezpieczeństwa, nowe spojrzenie na architekturę IT i świadome antycypowanie zagrożeń zamiast reaktywnego gaszenia pożarów. Nie możemy pozwolić sobie na bierne czekanie, aż impostor zostanie przypadkiem wyłapany przez tradycyjne systemy detekcji – stawka jest zbyt duża.

W świecie, w którym AI staje się wszechobecnym elementem procesów biznesowych, każda organizacja musi przygotować się na nieustanną grę w cyfrowe „Among Us”. Odróżnianie uprawnionych procesów, agentów i interakcji od tych złośliwych wymaga nowych, inteligentnych rozwiązań bezpieczeństwa, łączących automatyzację, zaawansowaną analitykę i świadomą kulturę cyberbezpieczeństwa w całej organizacji

AI ułatwi phishing i wyłudzenie

Trend Micro przewiduje, że w 2026 r. phishing i oszustwa online będą jeszcze trudniejsze do wykrycia. Antywirusy, które rozpoznają literówki czy sztuczny język, będą bezradne, bo treści przygotuje AI, dopasowując styl do odbiorcy na podstawie danych publicznych i mediów społecznościowych.

Coraz częstsze będą też czaty udające obsługę klienta lub dział bankowy. AI generująca naturalny głos posłuży do rozmów nakłaniających ofiary do przekazania dostępu do pieniędzy. Narzędzia tego typu są tanie, więc próg wejścia dla oszustów dramatycznie spada.

Konieczne będzie – wskazuje Trend Micro – tworzenie nowych systemów bezpieczeństwa wykrywających treści wygenerowane przez AI. W przyszłości pojawią się systemy naśladujące emocje i głos, ale 2026 r. nie będzie jeszcze rokiem, w którym AI całkowicie zastąpi ludzkiego oszusta.

Niestety analitycy Trend Micro nie mają dobrych wieści w sprawie ransomware. Ataków będzie więcej, choć żądania okupu mogą być niższe – AI umożliwi błyskawiczną analizę wykradzionych danych i wybór nowych, słabo chronionych celów.

Do tego agenci AI pozwolą przeprowadzać atak ransomware i wiele innych akcji na ogromną skalę nawet niedoświadczonym osobom.

Raport podsumowuje: zmieniają się metody ataku, cele pozostają te same – przerwanie pracy, kradzież, przejęcie kontroli. Działy cyberbezpieczeństwa muszą odejść od stałych schematów i zacząć adaptować się do narzędzi przeciwnika. A jeśli atak się uda – trzeba jak najszybciej naprawić luki i zabezpieczyć system, by nie dopuścić do powtórki.

Główne wnioski

- AI staje się głównym narzędziem cyberprzestępców, pozwalając automatyzować ataki, generować phishing i prowadzić działania na skalę wcześniej niedostępną bez dużych zasobów. Wraz z agentami AI rośnie ryzyko przejęcia kontroli nad systemami firmowymi oraz manipulacji danymi i urządzeniami.

- Zagrożenia w 2026 r. będą znacznie bardziej realistyczne i spersonalizowane m.in. dzięki deepfakes, fałszywym rozmowom głosowym i podszywaniu się pod znane osoby. Tradycyjne metody ochrony będą coraz mniej skuteczne, bo treści generowane przez AI są naturalne i trudne do wykrycia.

- Firmy muszą zmienić podejście do cyberbezpieczeństwa, przechodząc na systemy zdolne do wykrywania treści generowanych przez AI i reagowania w czasie rzeczywistym. Obrona statyczna przestaje wystarczać – konieczna jest adaptacja, szybkie łatanie luk i stosowanie agentów AI po stronie bezpieczeństwa.