Startuje ChatGPT Health. Zastąpi lekarzy? „Mam nadzieję, że nie. To niesprawdzony produkt” (WYWIAD)

OpenAI ogłosił, że uruchamia ChatGPT Health, argumentując to potrzebami – każdego tygodnia 230 mln ludzi na świecie zadaje pytania dotyczące zdrowia. Trzeba pamiętać, że AI nie zawsze mówi prawdę, ostrzega w rozmowie ekspertka od rozwiązań AI w medycynie. Jej rekomendacja: trzeba promować certyfikację i wdrażanie w medycynie sprawdzonych, skutecznych rozwiązań opartych o algorytmy AI. „Zamiast z internetowego czata pacjenci mogliby korzystać z potwierdzonych algorytmów AI pod nadzorem swojego lekarza” – mówi Ligia Kornowska z Koalicji AI w zdrowiu, współzałożycielka firmy Data Lake.

Z tego artykułu dowiesz się…

- Jak i w jakich krajach ma działać ChatGPT Health oraz dlaczego nie może być traktowany jako substytut lekarza.

- W jakich procedurach medycznych już dziś stosuje się certyfikowane rozwiązania oparte na AI.

- Czy obecność sztucznej inteligencji w diagnostyce oznacza spadek jakości pracy lekarzy.

Katarzyna Mokrzycka, XYZ: OpenAI zapowiedział uruchomienie ChatGPT Health. Formalnie, jak pisze firma, to „dedykowane rozwiązanie, które bezpiecznie łączy informacje o Twoim zdrowiu z inteligencją ChatGPT, aby służyć lepszą pomocą podczas poszukiwania informacji na temat kwestii zdrowotnych”. OpenAI przyznaje, że pytania dotyczące zdrowia są jednymi z najczęściej zadawanych czatowiGPT. Czy Pani zdaniem to będzie przełom? Czy dzięki takiemu rozwiązaniu może się faktycznie zmienić model leczenia ludzi na świecie?

Ligia Kornowska, Data Lake: Mam nadzieję, że nie, ponieważ ChatGPT Health to niesprawdzony produkt. W tym sensie, że nie jest certyfikowanym wyrobem medycznym. W tej chwili nie wiemy, na ile ChatGPT Health powie nam prawdę lub nieprawdę, jeśli będzie analizował nasze wyniki badań. Jeśli nie mamy pewności, jaka jest skuteczność algorytmu – a to oznacza, że nie wiemy również, jaka jest jego nieskuteczność – to w żadnym wypadku nie możemy opierać decyzji diagnostyczno-leczniczych na wynikach przez niego podawanych. Mam nadzieję, że w kontekście twardej analizy diagnostyczno-leczniczej czat nie będzie wykorzystywany. W Europie nie byłoby to legalne.

Czat lekarza nie zastąpi

Czat może nam dawać miękkie wytyczne dotyczące wellness, treningu czy żywienia. Może też pomóc, przypominając o wykonaniu badań profilaktycznych, zasugerować, że warto bardziej zadbać o sen lub zwrócić uwagę na to, co jemy. Tak też swoje narzędzie opisuje dziś OpenAI.

Chat GPT Health nie powinien natomiast mieć decydującego wpływu na ścieżkę diagnostyczną, a już tym bardziej na leczenie pacjenta.

Warto wiedzieć

Ligia Kornowska

Lekarz i liderka Koalicji AI i innowacji w zdrowiu. Aktywistka w obszarze innowacji w medycynie. Jest zaangażowana w cyfrową transformację ochrony zdrowia, zwłaszcza w obszarze sztucznej inteligencji i danych medycznych. Współzałożycielka firmy Data Lake, działającej w obszarze udostępniania danych medycznych i technologii blockchain w służbie badań naukowych. Wcześniej pełniła funkcję wiceprezydenta IFMSA-Poland (Międzynarodowego Stowarzyszenia Studentów Medycyny). Współtworzyła i prowadziła stowarzyszenie młodych menedżerów medycyny działające przy PFSz.

Na razie rozwiązanie jest dostępne w USA. W Europie nie, ale to pewnie tylko kwestia czasu, zanim wyleje się na inne rynki. Obie mamy świadomość, że przy dużych ograniczeniach dostępu do lekarzy specjalistów trzeba się spodziewać, że ludzie będą pytać czat nie o to, jak poprawić sen, tylko o to, co im dolega i jak się leczyć. OpenAI jest pierwszy z tym rozwiązaniem, ale na pewno nie ostatni. Nie da się zabronić ludziom pytania sztucznej inteligencji o kwestie zdrowotne. Można jednak zabronić dostawcom udzielania odpowiedzi, tak jak to zrobiono w Chinach. Czy to miałoby sens?

Zabronienie tego to byłaby opcja atomowa. Trudno zatrzymać rozwój. To tak samo, jakbyśmy pacjentom zakazali używania wyszukiwarki internetowej do wyszukiwania objawów zdrowotnych. Ale każdy z użytkowników, wykorzystując niecertyfikowany wyrób, jakim jest czat, musi pamiętać, że to nie są informacje medyczne. Że mogą być nieprawdziwe. Nie mogą być podstawą w leczeniu. I to w czacie powinna być zawarta taka obowiązkowa informacja, że to nie jest wyrób medyczny. Że nikt nie może być pewien tych odpowiedzi i że absolutnie trzeba sprawdzać rekomendacje czy analizę wyników z fachowcem. Przecież każdy, kto wypróbował AI do poszukiwania odpowiedzi w różnych innych dziedzinach, złapał ją chociaż raz na przekazywaniu informacji niezgodnych z rzeczywistością, prawda?

Rozpoczynają się już dyskusje, czy taki czat GPT może zastąpić personel medyczny. I to trzeba powtarzać w nieskończoność, że absolutnie nie.

To dopiero pierwszy etap czatów w zdrowiu, etap przejściowy zapewne. OpenAI zapewnia, że przy tworzeniu swojego produktu przez dwa lata współpracował z 260 lekarzami różnych specjalizacji z 60 krajów. Czy czat GPT może się stać przydatny dla systemowych rozwiązań opieki medycznej? Da się kiedyś włączyć wsparcie takiego czata do procesu formalnej konsultacji medycznej? Ja sobie wyobrażam taki model, że ja w domu pytam o poradę czata, czat wskazuje możliwy problem. Lekarz rodzinny to widzi w systemie POZ i zleca badania. Następnie wyniki ocenia i AI, i lekarz. Dzięki temu lekarz ma „drugą opinię”, ale też kontrolę nad diagnozą, a zwłaszcza kontrolę nad tym, co rekomenduje czat. To możliwe?

Jak najbardziej wyobrażam sobie scenariusz, w którym duże modele językowe wspierają w pewnych zakresach proces leczenia. Co więcej, niektóre duże modele językowe mogą nie potrzebować certyfikacji jako wyrób medyczny. Ale wtedy muszą być dostosowane swoim przekazem do pacjenta. Na przykład algorytm mógłby informować pacjenta, jakie są bezpłatne programy profilaktyczne w województwie albo w mieście pacjenta, z których ta konkretna osoba mogłaby lub powinna skorzystać. Wychodzenie do ludzi z działaniami prewencyjnymi jest bardzo dobrą formą wspomagania pacjenta. Czat informuje człowieka, co dalej ma zrobić.

Nie wiem, czy organizacyjnie bylibyśmy w stanie wdrożyć takie rozwiązanie, aby lekarz rodzinny miał podgląd tego, o co pacjent pytał czata. Liczba zapytań to miażdżąca skala. Lekarze rodzinni nie byliby w stanie mieć kontroli nad wszystkimi pytaniami zdrowotnymi.

Algorytm mógłby informować pacjenta, jakie są bezpłatne programy profilaktyczne w województwie albo w mieście pacjenta, z których ta konkretna osoba mogłaby lub powinna skorzystać.

Trzeba przyspieszyć wdrażanie AI do systemu

Trzeba się jednak spodziewać, że niezależnie od not informacyjnych i ostrzeżeń, tysiące ludzi będą w czatach szukać sposobów na samoleczenie – nie tylko diagnozy, ale też możliwości pozyskania jakiejś terapii. Czy to nie zwiększy szarej strefy handlu lekami w sieci?

Z pewnością rynek się zmieni. I to się już dzieje. Pacjenci już wyszukują w sieci informacji zdrowotnych. Niektórzy nawet podejmują się „leczenia”, a nawet są w stanie skorzystać z czarnego rynku. Mogą sami załatwić sobie leki na receptę bez kontroli lekarza. Dostępne duże modele językowe, które będą opowiadać człowiekowi w potrzebie o jakiejś dostępnej ścieżce leczenia z poziomu autorytetu, mogą ten obszar znacząco powiększyć.

Jest na to jakieś rozwiązanie? Będą się pojawiały kolejne modele językowe, które będą udzielać wskazówek, nawet jeśli będą zastrzegać, że to nie jest porada lekarza, skonsultuj się z profesjonalistą i tak dalej. OpenAI dąży do wypracowania osobistego asystenta dla każdego, więc firmie zależy na budowaniu osobistych relacji na odcinku czat–człowiek. Co można zrobić systemowo, żeby zwiększyć bezpieczeństwo takich usług albo zbudować kontrolowalną przeciwwagę dla czata z prywatnego big techu?

Warto promować tworzenie i wdrażanie certyfikowanych wyrobów medycznych opartych na algorytmach, co do których jesteśmy pewni, jaka jest ich efektywność i skuteczność – tam, gdzie już mamy dowody naukowe, że rozwiązania AI działają co najmniej tak dobrze jak lekarz. Promując wdrażanie takich rozwiązań, trzeba też promować ich wykorzystanie przez lekarzy – rodzinnych czy specjalistów. Taki lekarz, mając pod opieką już rozpoznanych pacjentów, mógłby dać im możliwość korzystania z certyfikowanego wyrobu medycznego opartego na algorytmach AI, który udzielałby dodatkowych informacji w sytuacjach, gdy lekarz nie byłby dostępny. Zamiast z internetowego czata pacjenci mogliby korzystać z potwierdzonych algorytmów AI pod nadzorem swojego lekarza. Nie byłoby to tak szybkie i ogólnodostępne, jak w tej chwili są duże modele językowe. Jednak dostosowanie systemu do zmieniającego się świata wydaje się nieuchronne.

Czyli trzeba przyspieszyć proces wdrażania w systemie ochrony zdrowia rozwiązań opartych na sztucznej inteligencji. Co stoi na przeszkodzie?

To zmiana, która wiąże się przede wszystkim z ustaleniem ścieżki finansowania kolejnych certyfikowanych wyrobów medycznych opartych na AI w polskim systemie ochrony zdrowia. Konieczna jest też edukacja personelu medycznego, że z takich rozwiązań warto korzystać. Potencjalnie zastosowanie nowoczesnych technologii może pomóc objąć opieką większą liczbę pacjentów.

Zmiana podejścia u medyków

A czy to oznacza, że w tej chwili jest jakaś niechęć po stronie medyków?

To zależy oczywiście od konkretnej grupy medyków. Sektor sztucznej inteligencji w zdrowiu to bardzo młody obszar. ChatGPT ma około czterech lat. On też dopiero się rozwija. Jeśli więc chcielibyśmy, żeby personel faktycznie szeroko stosował algorytmy AI, to po pierwsze personel musi rozumieć, czym są te algorytmy, kiedy i w jaki sposób można je wykorzystywać, tak, żeby było to bezpieczne i skuteczne dla pacjenta.

No i oczywiście musimy pokazywać dobre, udane przykłady wdrożeń. W ten sposób personel, niezależnie od tego, czy jest przekonany, będzie wiedział, że takie narzędzia mogą pomóc w opiece zdrowotnej. W tej chwili na kierunkach medycznych, gdzie uczymy nowe pokolenia lekarzy, mało się mówi o technologiach cyfrowych. A o sztucznej inteligencji jeszcze mniej. Należałoby to zmienić, jeśli chcemy unowocześniać system leczenia w Polsce.

AI w zdrowiu, której nie widzimy

Czy obecnie AI w zdrowiu to hit czy kit? Dużo się mówi, że gdzieś w czymś jest stosowana AI, ale w praktyce AI w zdrowiu częściej doświadczamy, korzystając właśnie z czatów AI, niż z rozwiązań prawdziwie medycznych.

Zdecydowanie hit.

Co realnie dziś potrafi sztuczna inteligencja (AI) w usługach zdrowotnych i naukach medycznych? Większą rolę odgrywa w diagnostyce czy na przykład w odkrywaniu nowych leków i terapii?

Sztuczna inteligencja w zdrowiu już ma spektakularne sukcesy, zarówno za granicą – w Stanach i w Europie – jak i w Polsce. Jest to przede wszystkim widoczne w radiologii, gdzie algorytmy AI pomagają w diagnozowaniu różnych stanów na obrazach medycznych, takich jak tomografia komputerowa, RTG czy rezonans magnetyczny.

W tym zakresie sztuczna inteligencja wykorzystywana jest również w polskich szpitalach. Raport o stanie i stopniu informatyzacji polskich szpitali, opublikowany przez Centrum e-Zdrowia, mówi, że w 2024 r. ponad 13 proc. szpitali już korzystało z AI. Trochę więcej niż połowa z nich wykorzystywała AI właśnie do wspomagania diagnostyki obrazowej. Zaraz za radiologią jest kardiologia. Nawet w tak humanistycznych dziedzinach jak psychiatria pojawiają się już algorytmy AI wspierające diagnostykę.

AI jest też z powodzeniem wykorzystywana przez firmy farmaceutyczne do odkrywania nowych terapii. Pomaga na przykład zawęzić grupę kilkunastu tysięcy potencjalnych cząsteczek do kilku tysięcy, które mają największy potencjał do stworzenia nowego leku. To istotnie skraca czas jego opracowania. W Stanach prowadzone są też badania, w których AI wykorzystywana jest do tworzenia tzw. cyfrowych bliźniaków pacjentów biorących udział w badaniach klinicznych. Dzięki temu można symulować, jak wyglądałby ich stan zdrowia bez leku, podczas gdy fizycznie otrzymują oni preparat testowany w badaniu. W ten sposób AI pozwala ograniczyć liczebność grupy kontrolnej.

Skoro to AI określa stan zdrowia bez podania testowanego leku, to czy nie będą już potrzebne grupy placebo? Zawsze uważałam za etycznie sporne to, że jednych się leczy, a inni tylko myślą, że się ich leczy.

Być może w przyszłości rzeczywiście nie będzie placebo. Na razie jednak AI pozwala raczej zmniejszyć grupę kontrolną, a nie całkowicie ją wyeliminować. Dopóki nie będziemy mieć absolutnej pewności – co wymaga wielu lat badań – że algorytmy wiernie odzwierciedlają rzeczywisty przebieg choroby, nie możemy zrezygnować ze sprawdzonych metod. Już samo ograniczenie liczby pacjentów w grupie placebo to jednak istotne usprawnienie procesu badań klinicznych oraz obniżenie ich kosztów.

Świat bez chorób dzięki AI?

Czy AI pomaga już eliminować choroby albo przynajmniej przyspiesza ich wykrywanie, zanim pojawią się objawy?

Powstają algorytmy, które z dużym prawdopodobieństwem przewidują przyszłe schorzenia. Kilka miesięcy temu w „Nature” opublikowano pracę o algorytmie prognozującym ponad tysiąc chorób na podstawie ograniczonego zestawu danych. Inny algorytm – z wcześniejszej publikacji – przewiduje ponad trzy tysiące schorzeń, korzystając z szerszego zakresu informacji o pacjentach, którzy jeszcze nie zostali zdiagnozowani.

Czy każdego można w ten sposób zdiagnozować indywidualnie? Ja, wprowadzając moje wymagane dane medyczne, mogę liczyć, że algorytm powie mi, na co zachoruję w ciągu najbliższych 20 lat?

Algorytmy operują na poziomie prawdopodobieństw. To analityka predykcyjna – dziś najbardziej przełomowy obszar AI w medycynie. Pozwala ona przesuwać medycynę z reaktywnej w proaktywną, czyli umożliwiać działania profilaktyczne jeszcze zanim pojawią się objawy choroby. To może zasadniczo zmienić sposób funkcjonowania opieki zdrowotnej.

Pozwoli na przykład wdrażać interwencje zdrowotne jeszcze zanim pojawią się objawy choroby albo zanim ona się rozwinie. To zupełnie inna medycyna niż dotychczas.

Kilka miesięcy temu w „Nature” opublikowano pracę o algorytmie prognozującym ponad tysiąc chorób na podstawie ograniczonego zestawu danych. Inny algorytm – z wcześniejszej publikacji – przewiduje ponad trzy tysiące schorzeń.

Ale jest haczyk – dokładność algorytmu, czyli jego skuteczność w przewidywaniu przyszłości zdrowotnej. Dziś skuteczność tych algorytmów jest jeszcze różna w zależności od tego, o jakiej chorobie mówimy. W niektórych przypadkach algorytm jest tak samo skuteczny jak nasze standardowe skale medyczne, które stosujemy w medycynie od lat. Na przykład skala ryzyka sercowo-naczyniowego. Jeśli wprowadzimy pięć podstawowych danych zdrowotnych, powie nam, czy w ciągu następnych dziesięciu lat występuje ryzyko zgonu z przyczyn sercowo-naczyniowych. Nie potrzebujemy do tego sztucznej inteligencji – wystarczy lekarz rodzinny.

To na czym polega przełomowość tych rozwiązań AI?

Stosowanie algorytmów AI całkowicie zmienia skalę rozpoznawania pewnych zjawisk. Dzięki AI będzie można diagnozować więcej chorób i z większą skutecznością. Obecne skale ryzyka określają na przykład ryzyko zgonu z przyczyn sercowo-naczyniowych na 20 proc. w ciągu najbliższej dekady. To jednak dość ogólna informacja. Algorytmy AI potrafią wskazać konkrety. Nie tylko, że chodzi o problemy sercowo-naczyniowe, ale na przykład, że z 90 proc. prawdopodobieństwem pacjent rozwinie nadciśnienie. Albo że bez zmiany trybu życia z 95 proc. prawdopodobieństwem zachoruje na cukrzycę.

Polskie ścieżki wdrożeń

I tu pojawia się przestrzeń dla medycyny spersonalizowanej? Jak szybko osiągniemy moment, w którym każdy z nas będzie mógł wykonać dla siebie taką pogłębioną analizę? Za pięć, dziesięć czy dwadzieścia lat?

To już się dzieje. Jest polski startup, który oferuje wspierane sztuczną inteligencją rozwiązanie do podstawowego triażu. Gdy pacjentowi coś dolega, może szybko uzyskać informację, co powinien zrobić. Czy zgłosić się na SOR, czy spokojnie umówić wizytę u lekarza? A może zostać w domu, bo nie ma realnego powodu do niepokoju.

W 2018 r. w Stanach Zjednoczonych zatwierdzono pierwszy algorytm oparty na sztucznej inteligencji, który samodzielnie, bez udziału lekarza, mógł wydać wynik diagnostyczny z badania dna oka – kluczowego m.in. dla osób z cukrzycą, którym grozi utrata wzroku. Wcześniej wykonane przez pacjenta zdjęcie musiał ocenić lekarz. Dziś istnieją algorytmy, które same analizują obraz, wykrywają powikłania i wskazują pacjentowi, czy potrzebna jest pilna konsultacja, czy może zgłosić się do lekarza w innym terminie.

O wdrażaniu tych nowoczesnych narzędzi w medycynie myśli już również Ministerstwo Cyfryzacji. W polityce cyfryzacji kraju jest cały rozdział dotyczący ochrony zdrowia. Jeden z punktów dotyczy wdrożenia narzędzi opartych na analityce predykcyjnej dla całego społeczeństwa.

Wydaje się, że o wdrażaniu tych nowoczesnych narzędzi w medycynie myśli już również Ministerstwo Cyfryzacji. W polityce cyfryzacji kraju jest cały rozdział dotyczący ochrony zdrowia. Jeden z punktów dotyczy wdrożenia narzędzi opartych na analityce predykcyjnej dla całego społeczeństwa. To najpewniej nie będzie jedno narzędzie, które analizuje stan zdrowia wszystkich Polaków i wszystkie choroby. Spodziewam się raczej wyboru określonych narzędzi AI do realizacji konkretnych zadań, na przykład przewidywania ryzyka nadciśnienia, chorób płuc czy cukrzycy. Chodzi o większą kontrolę nad chorobami, które powodują największe problemy w leczeniu lub najwyższą śmiertelność.

Dane wrażliwe to dane niezbędne

To się przecież nie odbędzie „na piękne oczy”. AI, żeby móc przewidywać, musi mieć dostęp do naszych danych.

Absolutnie tak – zaczynając od tego, że jeśli chcemy korzystać z rozwiązań spersonalizowanych, to musimy zacząć gromadzić dane o sobie, aby zasilać nimi sztuczną inteligencję. Chodzi tu na przykład o dane ze smartwatchy, które monitorują nasze tętno i puls, przez dane laboratoryjne, aż po dane genetyczne.

Nie da się tworzyć nowych rozwiązań bez dostępu do milionów rekordów danych. I to jest bardzo wrażliwy temat.

Bardzo trudno jest firmom uzyskiwać dostęp nawet do danych statystycznych czy w pełni anonimowych. Wciąż nie ma wytycznych dotyczących demokratycznego i transparentnego dostępu do danych.

Z jednej strony mamy ogromną potrzebę dostępu do tych danych, żeby tworzyć dużo bardziej zaawansowaną i skuteczną medycynę. Z drugiej strony mamy prawo do prywatności każdego pacjenta. Każdy z nas może się nie godzić na wykorzystanie swoich danych. Temat komplikuje fakt, że anonimizacja danych medycznych bywa dużym wyzwaniem. W chorobach ultrarzadkich nie wystarczy usunąć nazwiska, wieku czy miasta, żeby pacjent pozostał anonimowy.

W Polsce dostęp do danych to nadal wyzwanie. Mamy sporo rejestrów i baz danych medycznych różnej jakości, z których potencjalnie moglibyśmy korzystać przy opracowywaniu nowych metod leczenia. NFZ ma swoją bazę danych, Centrum e-Zdrowia ma swoją. Mamy też kilkanaście rejestrów medycznych zleconych przez Ministerstwo Zdrowia do prowadzenia. Jednak bardzo trudno jest firmom uzyskiwać do nich dostęp, nawet do danych statystycznych czy w pełni anonimowych. Wciąż nie ma wytycznych dotyczących demokratycznego i transparentnego dostępu do danych.

Blokada danych = blokada startupów

Czy to nie ogranicza rozwoju startupów medycznych w Polsce? Gdyby dostęp do danych był uregulowany, czy powstawałoby u nas więcej startupów w obszarze medycznym?

Nie wiem, czy powstawałoby ich więcej, ale te, które już są, mogłyby prowadzić znacznie więcej badań na znacznie większych zbiorach danych, co przekładałoby się na lepsze algorytmy sztucznej inteligencji. Na szczęście w przypadku rozwiązań AI nie zawsze musimy korzystać z danych Polaków – przydatne są również dane europejskie z innych krajów. Polskie startupy często sięgają po dane zewnętrzne, na przykład z Wielkiej Brytanii. To i tak lepsze rozwiązanie niż korzystanie z danych z Azji czy nawet ze Stanów Zjednoczonych. Tamte populacje mają inną charakterystykę niż europejska. Algorytmy mogą dawać inne wyniki dla pacjentów z Europy niż dla pacjentów z Azji.

To może powodować, że twórcy startupów od razu celują nie w rynek europejski – a już na pewno nie tylko w polski – lecz w znacznie większy rynek, na przykład Stanów Zjednoczonych.

Tak się często dzieje. Jeśli jednak startup chce działać w Polsce, to zwykle występuje o dostęp do danych od konkretnych pacjentów. Znam kilka firm, które poszły tą drogą i wykorzystują dane przekazane przez pacjentów na przykład do badań naukowych albo eksperymentów medycznych.

Czy to jest ścieżka zautomatyzowana, czy startup za każdym razem, gdy trafi na ciekawy przypadek, musi pytać pacjenta o zgodę?

Za każdym razem trzeba przeprowadzić tę procedurę, a zgoda musi być szczegółowa. Niestety oznacza to, że badania prowadzi się na nieproporcjonalnie małej grupie pacjentów. Może to być kilkaset osób, kilka tysięcy to już naprawdę bardzo duże badania. Tymczasem dopiero miliony rekordów pozwoliłyby wytrenować znacznie skuteczniejszy algorytm.

Europa nie ma nawet listy certyfikowanych metod AI

Ile mamy w obiegu usług medycznych takich certyfikowanych narzędzi opartych na algorytmach AI?

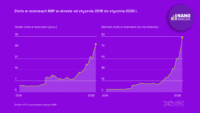

W Europie i USA łącznie jest ich już kilka tysięcy. Ten rynek błyskawicznie rośnie. Trzy lata temu było ich może po tysiąc w Stanach i w Europie.

A w Polsce?

Jeśli algorytm jest certyfikowany jako wyrób medyczny na Europę, to w Polsce również. Na przykład rozwiązania do oceny badań radiologicznych, o których mówiłam na początku – one muszą mieć certyfikat jako wyrób medyczny, bo inaczej ich stosowanie do wspierania diagnostyki byłoby nielegalne. Niestety nie znalazłam w Europie bieżących statystyk pokazujących, które algorytmy mają certyfikację. W Stanach taka lista jest regularnie uzupełniana, w Europie jej w ogóle nie ma.

Z jakich rozwiązań pani osobiście korzysta?

Na przykład korzystałam z AI do analizy zmiany skórnej. Wystarczy zdjęcie zrobione smartfonem, które ocenia algorytm AI. Jest to certyfikowany wyrób medyczny przeznaczony dla pacjenta.

Często, jak w przypadku narzędzi radiologicznych, producent zapisuje, że jest to wyrób medyczny przeznaczony dla specjalisty medycznego – i te są lepiej kojarzone. Ale w Polsce całkiem sporo różnych algorytmów AI jest już dostępnych także dla indywidualnych pacjentów. Ponieważ jednak zwykle działają odpłatnie, a nie są refundowane, pozostają mało popularne.

Refundacja AI zmieni rynek medyczny

Przyzwyczailiśmy się, że sztuczna inteligencja jest za darmo. Czy po stronie publicznej, czyli po stronie płatnika w usługach medycznych, ktoś pracuje nad refundacją narzędzi AI?

Agencja Oceny Technologii Medycznych i Taryfikacji (AOTMiT) stworzyła wytyczne dotyczące finansowania innowacyjnych wyrobów medycznych. Trwa wokół nich dyskusja, bo zaprojektowanie dobrego i szybkiego schematu refundacji innowacji to bardzo trudne zadanie. Wytyczne są jednak ważnym krokiem w kierunku obejmowania finansowaniem publicznym innowacyjnych wyrobów medycznych. Nie chodzi o testowanie nowinek za publiczne pieniądze – mówimy o narzędziach o potwierdzonej skuteczności działania. Miejmy nadzieję, że wytyczne zostaną szybko przyjęte i wreszcie usprawnią proces pozyskiwania refundacji na najbardziej innowacyjne technologie.

Oprócz tego powstał zespół wspólny Ministerstwa Cyfryzacji i Ministerstwa Zdrowia, który ma zajmować się cyfryzacją zdrowia i wdrażaniem innowacyjnych rozwiązań. To dobry kierunek, bo cyfryzacja ochrony zdrowia leży w kompetencjach obu resortów. Wspólny zespół daje nadzieję, że działania przyspieszą i będą lepiej skoordynowane.

Czy AI osłabia umiejętności lekarza?

W sierpniu ukazały się wyniki głośnego badania, z którego wynikało, że lekarze stosujący w kolonoskopii sztuczną inteligencję osłabili swoje własne umiejętności w wykrywaniu polipów bez udziału AI. To wystraszyło ludzi, a nawet lekarze krytykowali ten efekt. Pani także? Czy w zdrowiu to groźne zjawisko, gdy technologia zaczyna być lepsza niż człowiek?

Bardzo się cieszę, że pani zadała to pytanie. To naturalne, że gdy wchodzi nowa technologia, która pozwala diagnozować i leczyć pacjenta skuteczniej, dotychczasowe umiejętności lekarzy się zmieniają. Nie ma się czego obawiać, że lekarz przestaje uchem czy okiem wyłapywać to, do czego ma mu służyć narzędzie AI. On nie jest przez to gorszym lekarzem – on po prostu zmienia metody pracy.

Czy wie pani, że istnieje takie badanie, jak opukiwanie serca albo opukiwanie płuc?

Wiem, że było praktykowane kiedyś. Widziałam w filmach.

No właśnie. Ja osobiście uczyłam się jeszcze tego na studiach, chociaż już wtedy było to bez sensu. Dziś zamiast tego można po prostu wykonać USG serca czy płuc. USG daje znacznie pełniejszą i bardziej jednoznaczną odpowiedź niż opukiwanie, pozwalając ocenić pacjenta dużo bardziej całościowo. Czy wejście USG do praktyki lekarskiej ograniczyło umiejętności lekarzy w diagnozowaniu pacjenta, bo nie potrafią już opukiwać? Faktycznie mają mniejsze umiejętności w opukiwaniu, bo już tego nie robią – ale po co mieliby to robić, skoro inne metody dają lepszą diagnostykę?

Podobnie jest z kolonoskopią. AI wykrywa zmiany dokładniej, więc czy lekarz ma się z nią ścigać? Jeśli badania naukowe pokażą, że dany algorytm AI ma wysoką czułość i rzadko popełnia błędy, nie widzę powodu, by lekarz miał z niego nie korzystać – tak samo jak korzysta z USG czy tomografii.

To naturalne, że gdy wchodzi nowa technologia, która pozwala diagnozować i leczyć pacjenta skuteczniej, dotychczasowe umiejętności lekarzy się zmieniają. Nie ma się czego obawiać, że lekarz przestaje uchem czy okiem wyłapywać to, do czego ma mu służyć narzędzie AI. On nie jest przez to gorszym lekarzem – on po prostu zmienia metody pracy.

Kogo (nie) będzie stać na kupno AI w medycynie?

Czy, żeby przyspieszyć wdrażanie nowoczesnych rozwiązań, można w Polsce wykorzystać istniejącą już infrastrukturę cyfrową? Chwalimy się wprawdzie na całą Europę naszym systemem e-recept, mamy Internetowe Konto Pacjenta, ale już elektroniczny obieg dokumentów medycznych między placówkami medycznymi średnio się udał, bo nadal nie działa. Czy bez tych brakujących elementów można zrobić użytek z tych, które funkcjonują sprawnie?

Zdecydowanie możemy i powinniśmy wykorzystać do wdrożeń algorytmów AI istniejący system cyfrowych usług medycznych. Ja dużo mniej surowo oceniam stan cyfryzacji zdrowia w Polsce. Na przykład prosty system e-recept działa już od paru lat świetnie. Już ponad 97 proc. lekarzy wystawia e-recepty. System gromadzi centralnie dużo informacji. To ogrom wiedzy o pacjencie, nawet jeśli nie mamy całej dokumentacji medycznej. Ten system może być wykorzystany przy wdrażaniu rozwiązań opartych na algorytmizacji albo sztucznej inteligencji – bo algorytmy to nie zawsze sztuczna inteligencja. Przykładowo, możemy wdrożyć system, który, analizując wcześniej wystawione i zrealizowane recepty, pokaże, że pacjent jest nieoptymalnie leczony i mógłby dostać lek B, który lepiej odpowiadałby na jego potrzeby zdrowotne. Nawet nie trzeba łączyć się z całym systemem P1, w którym jest indeksowana dokumentacja medyczna. Już na podstawie samych danych o receptach narzędzie AI może wyświetlić lekarzowi sugestię działania.

Jak duże jest ryzyko, że korzystanie ze sztucznej inteligencji zwiększy nierówności w dostępie do opieki medycznej? Nie ma w Polsce spójnego systemu zarządzania tymi usługami. Nie każdy szpital stać na najnowocześniejsze technologie, a to oznacza, że pacjent małego szpitala powiatowego nie otrzyma takiej samej opieki jak pacjent dużego szpitala klinicznego, prawda?

To ogólne wyzwanie dotyczące wszystkich interwencji medycznych, nie tylko rozwiązań AI. Szpital, który ma pieniądze na nowszy tomograf, będzie uzyskiwał dokładniejsze wyniki niż placówka korzystająca z ośmioletniego urządzenia.

Będzie różnica w jakości obrazów, które są oceniane – tak po prostu działa system ochrony zdrowia.

Nowe technologie wzmacniają istniejące nierówności. Mogą skokowo poprawić jakość leczenia, ale też pogłębiać różnice w dostępie do niego. Mając to na uwadze, trzeba projektować systemy i wdrażanie AI w taki sposób, aby te nierówności ograniczać, choć całkowicie ich wyeliminować się nie da.

Sama możliwość pogłębiania nierówności nie powinna jednak blokować stopniowego wdrażania algorytmów. Pilotażowe wdrożenia na mniejszą skalę pozwalają sprawdzić, jak algorytm działa w konkretnym środowisku – w danym szpitalu, z konkretnymi lekarzami i pacjentami. Nawet certyfikowany wyrób medyczny warto najpierw przetestować w realnych warunkach organizacyjnych, zanim trafi do szerokiego użycia. Zebranie doświadczeń i przejście tego procesu pilotażowego są kluczowe, żeby później dobrze to umieć wdrożyć na szerszą skalę.

Nadal będziemy potrzebować medyków

Czy rozwiązania oparte na AI odciążą finansowo system ochrony zdrowia – bo potrzeba będzie mniej diagnostów, lekarzy POZ czy hospitalizacji – czy przeciwnie, jeszcze bardziej obciążą NFZ i szpitale?

Wdrożenie każdej innowacji na początku kosztuje. Trzeba zainwestować środki, by w przyszłości ewentualnie wygenerować oszczędności. To, czy konkretne rozwiązanie AI będzie obciążeniem czy ulgą dla budżetu, zależy od jego ceny, modelu finansowania i rzeczywistej skuteczności.

W mojej ocenie AI nie zmniejszy popytu na lekarzy ani diagnostów laboratoryjnych.

Natomiast to, czego możemy być w miarę pewni, to to, że takie algorytmy będą przyspieszały proces diagnostyki i zwiększały jego jakość, przez co pacjent będzie lepiej zaopiekowany.

W mojej ocenie AI nie zmniejszy natomiast popytu na lekarzy ani diagnostów laboratoryjnych. Sektor ochrony zdrowia charakteryzuje się tym, że zawsze pojawiają się nowe potrzeby zdrowotne. Lepsza opieka zdrowotna oznacza na przykład dłuższe życie. Dłuższe życie oznacza więcej chorób, a więcej chorób – większe korzystanie z systemu ochrony zdrowia. Luka potrzeb zdrowotnych będzie mniejsza, ale raczej szybko nie zniknie. Może w przyszłości, gdy będziemy mieć algorytmy, które od dnia urodzenia człowieka będą analizować jego stan zdrowia, dzień po dniu, i z dużą skutecznością zapobiegać rozwojowi chorób…

To futurologia czy projekt w realizacji?

Zazwyczaj nie doceniamy szybkości rozwoju. Dziś to jeszcze futurologia, ale może się to zmienić szybciej, niż nam się wydaje.

Główne wnioski

- ChatGPT Health – brak przełomu w diagnostyce i leczeniu. Ligia Kornowska ostrzega, że ChatGPT Health nie jest certyfikowanym wyrobem medycznym, jego odpowiedzi mogą być nieprawdziwe, a w Europie używanie go do podejmowania decyzji diagnostyczno-leczniczych byłoby nielegalne. Może wspierać wellness i profilaktykę, ale nie powinien wpływać na ścieżkę leczenia. Zamiast niesprawdzonych czatów ekspertka zaleca stosowanie potwierdzonych algorytmów AI pod nadzorem lekarza.

- AI w medycynie to hit, nie kit. Sztuczna inteligencja już osiąga realne sukcesy – przede wszystkim w diagnostyce obrazowej (radiologia, kardiologia), w przyspieszaniu odkrywania leków oraz w analityce predykcyjnej, która pozwala przewidywać choroby zanim się pojawią. W wybranych zadaniach algorytmy działają co najmniej tak dobrze jak lekarze. W Polsce ponad 13 proc. szpitali korzysta już z AI, głównie w diagnostyce obrazowej.

- Klucz do bezpiecznego rozwoju: certyfikacja, edukacja i dane. Aby AI realnie poprawiała opiekę zdrowotną, potrzebne są: sprawna refundacja certyfikowanych narzędzi, edukacja personelu medycznego, ułatwiony dostęp do danych medycznych oraz pilotażowe wdrożenia. Wyzwaniem pozostaje ochrona prywatności pacjentów i sprawne procesy finansowania innowacji, ale stopniowe wprowadzanie sprawdzonych rozwiązań jest nieuniknione i korzystne dla systemu.