Jaka będzie AI za 5-10 lat? Prof. Przegalińska pokazuje scenariusze

Mythos to model, który nie tyle odpowiada na pytania, co potrafi prowadzić wielogodzinne lub wielodniowe projekty, samodzielnie weryfikować swoje wyniki i korygować błędy – mówi prof. Aleksandra Przegalińska, filozofka i badaczka nowych technologii. Co czeka nas w przyszłości?

Z tego artykułu dowiesz się…

- Czym różni się nowy model AI opracowany przez firmę Anthropic od dotychczasowych narzędzi.

- Jakie są możliwości modelu Mythos i dlaczego nowe narzędzie jednych ekscytuje, a innych przeraża.

- Jaka będzie AI przyszłości i czego możemy się spodziewać za 5–10 lat.

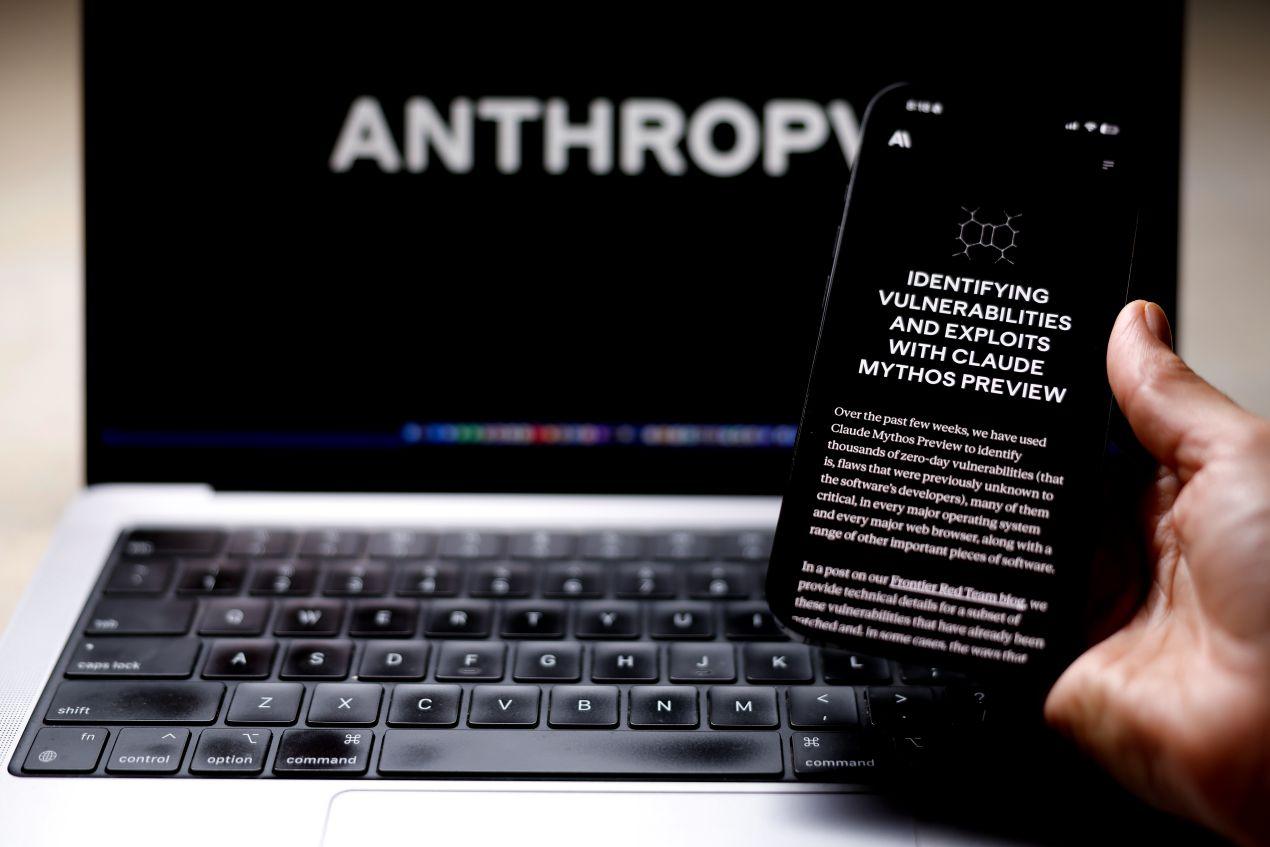

Łukasz Ostruszka, XYZ: Czy Mythos, nowy model językowy opracowany przez firmę Anthropic, rzeczywiście jest tak potężnym narzędziem?

Prof. Aleksandra Przegalińska, filozofka i badaczka nowych technologii: Trudno na ten moment ocenić to z całą pewnością. Nie mamy jeszcze niezależnych testów ani publicznie dostępnych benchmarków. To, co wiemy, opiera się na komunikacie samego producenta i wybiórczych informacjach z organizacji testujących. Sam fakt, że Anthropic decyduje się na tak ograniczone wdrożenie, jest jednak istotnym sygnałem. Ta firma od dawna stosuje politykę odpowiedzialnego skalowania, w której kolejne poziomy zdolności modelu wiążą się z kolejnymi poziomami zabezpieczeń. Jeśli model trafia tylko do czterdziestu podmiotów odpowiedzialnych za infrastrukturę krytyczną, to znaczy, że został zakwalifikowany do kategorii ryzyka, w której swobodne udostępnienie byłoby zbyt niebezpieczne.

Czy to oznacza, że jest niesamowicie potężny w sensie naukowym? Czy raczej w pewnych zastosowaniach jest po prostu zbyt skuteczny, żeby puszczać go w obieg? To są dwie różne rzeczy.

To nie jest AI do odpowiadania na proste pytania

Co takiego ma w sobie Mythos, czego nie mają inni?

Z dotychczasowych komunikatów wynikałoby, że Mythos wyróżnia się przede wszystkim zdolnością do długoterminowego, samodzielnego planowania i działania w złożonych środowiskach technicznych – w tym takich, które wymagają rozumienia systemów przemysłowych, sieci energetycznych lub logistyki. Mówiąc prościej: jest to model, który nie tyle odpowiada na pytania, co potrafi prowadzić wielogodzinne lub wielodniowe projekty, samodzielnie weryfikować swoje wyniki i korygować błędy. Kluczowa różnica wobec poprzedniej generacji to nie większa wiedza, ale większa autonomia w działaniu.

To kolejny przełom w rozwoju sztucznej inteligencji?

Mam dość mieszane uczucia wobec słowa „przełom”, bo używamy go w tej branży tak często, że trochę straciło ono na znaczeniu. Jeśli jednak rozumiemy przełom jako moment, w którym jakość modelu zmienia naturę problemów, jakie możemy mu powierzyć, to tak – prawdopodobnie mamy z nim do czynienia. Różnica między modelem, który pomaga człowiekowi pisać kod, a modelem, który samodzielnie projektuje i utrzymuje systemy, jest jakościowa, a nie tylko ilościowa. Z drugiej strony warto pamiętać, że każdy taki krok obnaża też nowe ograniczenia. Modele stają się coraz lepsze w wykonywaniu zadań, ale wciąż nie rozumieją świata tak jak my.

Warto wiedzieć

Prof. Aleksandra Przegalińska

Filozofka, badaczka rozwoju nowych technologii, humanoidalnej sztucznej inteligencji, robotów społecznych i technologii ubieralnych. Związana z Akademią Leona Koźmińskiego i Uniwersytetem Harvarda.

Mythos trafił do nieliczonych

Jak najprościej wyjaśnić ludziom obecną sytuację? Czym jest Mythos i dlaczego budzi takie podekscytowanie i obawy?

Mythos to nowy system, który jest na tyle zaawansowany, że jego twórcy sami uznali, iż nie powinien być powszechnie dostępny. Został więc udostępniony jedynie nielicznym instytucjom, które odpowiadają za takie zasoby jak prąd, woda, telekomunikacja czy bezpieczeństwo cyfrowe. Z jednej strony budzi to zachwyt – oznacza to, że mamy narzędzie, które potrafi pomóc utrzymać działanie kluczowych systemów, znaleźć w nich luki i optymalizować ich pracę.

Z drugiej strony budzi to obawy, ponieważ to samo narzędzie w nieodpowiednich rękach mogłoby zostać wykorzystane do atakowania tych systemów.

Każde zabezpieczenie jest grą w kotka i myszkę. Można jednak znacząco utrudnić nadużycia, łącząc kilka warstw ochrony.

Co mogłoby się zatem stać, gdyby tego typu narzędzia wpadły w niepowołane ręce? Czy da się je w ogóle zabezpieczyć przed czymś takim?

Scenariusze są dość poważne. Mówimy o modelu, który potencjalnie potrafi prowadzić zaawansowane operacje cybernetyczne, projektować nowe metody ataku na systemy przemysłowe czy wspierać grupy, które chcą destabilizować państwa. To nie science fiction – to ryzyka, o których w środowisku badawczym dyskutujemy od kilku lat. Jeśli pyta mnie pan, czy da się przed tym zabezpieczyć w 100 proc., to odpowiedź brzmi: nie. Każde zabezpieczenie jest grą w kotka i myszkę. Można jednak znacząco utrudnić nadużycia, łącząc kilka warstw ochrony.

Tarcza chroniąca?

Jakie to warstwy?

Po pierwsze, kontrola dostępu na poziomie infrastruktury – model nie jest udostępniany publicznie i działa wyłącznie w ściśle określonych środowiskach. Po drugie, ciągły monitoring sposobu jego użycia, z możliwością natychmiastowego odcięcia dostępu w czasie rzeczywistym. No i po trzecie, wewnętrzne mechanizmy modelu odmawiają wykonania określonych klas zadań. Kolejną warstwą są procedury audytu i odpowiedzialności po stronie użytkowników, które pozwalają śledzić, kto i w jakim celu korzysta z narzędzia.

Kto się boi nowego modelu AI?

Minister finansów Kanady określa Mythos jako zagrożenie dla stabilności porównywane z blokadą cieśniny Ormuz. Czy to nie przesada?

Ormuz to fizyczny punkt, którego zamknięcie blokuje przepływ około jednej trzeciej światowego eksportu ropy. Mythos jest zagrożeniem innego typu – raczej rozproszonym niż punktowym. Nie blokuje jednego korytarza, tylko zmienia warunki gry w wielu sektorach jednocześnie. To właśnie ten typ innowacji, do którego rynki i regulatorzy nie są przyzwyczajeni.

Z drugiej strony porównywanie pojedynczego modelu AI do zablokowania kluczowego szlaku energetycznego jest retorycznie efektowne, ale analitycznie nieprecyzyjne. Niestabilność, o której mówimy, ma inny charakter – jest wolniejsza, bardziej rozłożona w czasie i, co istotne, dotyczy raczej oczekiwań oraz zaufania niż natychmiastowych przepływów towarów.

Kroki milowe w rozwoju AI

Gdybyśmy mieli przedstawić rozwój AI na osi czasu i wymienić kolejne kroki milowe, co by pani umieściła na tej osi?

Zaczęłabym od lat pięćdziesiątych – konferencji w Dartmouth w 1956 r., kiedy ukuto samo pojęcie sztucznej inteligencji. Następnie lata osiemdziesiąte – okres systemów eksperckich oraz tzw. zimy AI, kiedy entuzjazm wyraźnie osłabł.

Kolejnym istotnym momentem był 1997 r. i zwycięstwo Deep Blue nad Garrym Kasparowem – symboliczny dowód, że maszyny mogą pokonywać człowieka w zadaniach wymagających strategicznego myślenia. Prawdziwa zmiana przyszła jednak później. W 2012 r. nastąpił przełom w głębokim uczeniu: model AlexNet wygrał konkurs ImageNet, wyraźnie dystansując wcześniejsze metody i pokazując, że sieci neuronowe trenowane na GPU mogą skutecznie rozpoznawać obrazy na niespotykaną wcześniej skalę. Kolejnym krokiem był 2016 r. i AlphaGo – system, który pokonał mistrza świata w grze w go. To wydarzenie pokazało, że uczenie ze wzmocnieniem pozwala maszynom radzić sobie w problemach o ogromnej złożoności, długo uznawanych za niedostępne dla AI.

W 2017 r. pojawia się architektura transformerów – fundament współczesnych modeli językowych. Lata 2020–2022 to GPT-3, ChatGPT i moment wejścia AI do masowej świadomości. Rok 2023 przynosi upowszechnienie modeli wielomodalnych, a 2024 – pierwsze systemy zdolne do dłuższego „namysłu” przed odpowiedzią. Rok 2026 to początek ery AI agentowej, czyli systemów działających bardziej jak wykonawcy zadań niż narzędzia do odpowiadania na pytania.

AI będzie się rozwijała w kilku nurtach

Postęp przyspiesza. Czego spodziewa się pani w najbliższych 5–10 latach? Jak sztuczna inteligencja będzie się rozwijała?

Najbardziej prawdopodobny scenariusz to kilka równoległych kierunków rozwoju. Pierwszy to dalszy wzrost zdolności agentowych – systemów, które potrafią prowadzić długotrwałe projekty zawodowe, od badań naukowych po administrację. Drugi to integracja AI z robotyką, czyli realna obecność tych technologii w świecie fizycznym – w fabrykach, ochronie zdrowia czy gospodarstwach domowych.

Trzeci nurt to specjalizacja – modele projektowane pod konkretne dziedziny, takie jak biologia molekularna, materiałoznawstwo czy prawo. Czwarty, być może najważniejszy, to rozwój regulacji i instytucji, które będą musiały odpowiedzieć na pytanie, kto kontroluje te systemy i według jakich zasad.

AI błądzi jak człowiek

Możliwe jest też pewne rozczarowanie. Część obietnic związanych z AGI – ogólną sztuczną inteligencją – najpewniej nie zmaterializuje się w zakładanym tempie. Modele będą coraz lepsze w wielu zadaniach, ale nadal będą popełniać błędy w trudny do przewidzenia sposób.

Najciekawsze nie musi być jednak to, co zrobi sama technologia, lecz to, jak zmieni sposób organizacji pracy ludzi i instytucji. Ten proces będzie wolniejszy, niż sądzą entuzjaści, ale jednocześnie głębszy, niż zakładają sceptycy.

Wspomniała pani o regulacji, kontroli i odpowiedzialności, a to wiąże się z wyścigiem mocarstw. Chińczycy też pokazali nowy model Deepseek. Na jakim poziomie są ich rozwiązania?

DeepSeek od dłuższego czasu pokazuje, że Chiny potrafią doganiać zachodnich liderów pod względem jakości modeli – i to często przy znacznie niższych kosztach treningu. To moment, w którym przestajemy mówić o jednoznacznej przewadze Stanów Zjednoczonych. Najnowsze modele DeepSeek w testach akademickich są bardzo blisko światowej czołówki – w niektórych zadaniach ją wyprzedzają, w innych pozostają nieco z tyłu.

Jednak rankingi benchmarków to tylko jeden wymiar. Drugi to ekosystem. Chiny rozwijają własne łańcuchy dostaw chipów, własne narzędzia i własne standardy bezpieczeństwa, które coraz wyraźniej różnią się od zachodnich. Trzeci wymiar to filozofia udostępniania. Wiele chińskich modeli publikowanych jest jako otwarte wagi [model AI, którego wytrenowane parametry są publicznie dostępne, dzięki czemu można go uruchamiać i modyfikować samodzielnie, bez korzystania z API twórcy – przyp. red.]., co zmienia dynamikę całego rynku – pozwala je pobierać, dostrajać i wdrażać bezpośrednio przez firmy czy instytucje.

To stawia zachodnie firmy w trudnej sytuacji. Muszą jednocześnie konkurować jakością i odpowiadać na rosnącą presję na większą otwartość.

W praktyce rozwój AI staje się coraz bardziej dwubiegunowy, a nawet wielobiegunowy – jeśli uwzględnimy rosnącą rolę Indii czy krajów arabskich. To jedna z kluczowych kwestii w najbliższej dekadzie – nie tylko technologiczna, ale również geopolityczna.

Rywalizacja mocarstw na rynku AI

Dojdzie do zderzenia różnych wizji? Mamy Chiny, które nie przejmują się regulacjami, Europę nakładającą ograniczenia i USA z potężnymi big techami, które chyba wymknęły się spod kontroli. Która wizja okaże się najlepsza dla człowieka w dalszej perspektywie?

Żadna z tych wizji nie zwycięży w czystej formie. To raczej współzależna ewolucja trzech modeli niż prosty wyścig. Chiny dominują dziś w robotyce przemysłowej i humanoidach, USA rozwija warstwę agentową i software intelligence. To nie są ścieżki konkurencyjne – one będą się przenikać. Agenci będą potrzebować „ciał”, a roboty – „rozumu”.

Europa ma w tym układzie realny problem, bo nie jest liderem ani w jednym, ani w drugim obszarze. Jej atuty to regulacje, dostęp do danych publicznych oraz silny przemysł, który mógłby absorbować robotykę. Bez własnych championów technologicznych grozi jej jednak rola wykonawcy cudzych wizji.

Wzmocnienie powinno iść w stronę konkretnych zastosowań – zdrowia, przemysłu czy sektora publicznego. Nie tylko kolejnych regulacji, lecz przede wszystkim budowy europejskich produktów z europejskimi wartościami wpisanymi w ich fundamenty.

Największe ryzyko nie polega na tym, która wizja wygra. Wszystkie trzy traktują AI przede wszystkim jako narzędzie geopolityczne lub ekonomiczne. Tymczasem powinna ona służyć przede wszystkim wzmacnianiu sprawczości tych, którzy mają jej najmniej.

Główne wnioski

- Mythos to nowy system, na tyle zaawansowany, że firma Anthropic uznała, iż nie powinien być powszechnie dostępny. Udostępniono go jedynie wybranym instytucjom odpowiedzialnym za kluczową infrastrukturę – prąd, wodę, telekomunikację czy bezpieczeństwo cyfrowe.

- To model zdolny do prowadzenia wielogodzinnych lub wielodniowych projektów, który samodzielnie weryfikuje wyniki i koryguje błędy.

- Według prof. Aleksandry Przegalińskiej AI będzie się rozwijała w kilku równoległych nurtach, z których kluczowy dotyczy nowej generacji regulacji. Instytucje będą musiały odpowiedzieć na pytanie: kto kontroluje rozwój tych systemów i według jakich zasad.