Facebook, Instagram i fala oszustw. „Meta większość zgłoszeń odrzuca lub nie reaguje”

W 2025 r. Ośrodek Analizy Dezinformacji działający przy NASK-u skierował do Mety ponad 9 tys. zgłoszeń wobec treści, które pojawiły się na platformie Facebook albo Instagram. Tylko w ciągu miesiąca zlokalizowano kilkanaście tysięcy przypadków wykorzystania wizerunków znanych osób. Meta większość zgłoszeń odrzuciła albo zignorowała – wynika z danych, do których dotarła redakcja XYZ. Przedstawiciele Mety nie zgadzają się z tym stwierdzeniem.

Z tego artykułu dowiesz się…

- Jak w praktyce wygląda sukces zgłaszania zagrożeń na platformach społecznościowych przez państwowy NASK.

- Dlaczego mimo tysięcy zgłoszeń składanych przez polskie instytucje, większość szkodliwych reklam pozostaje bez reakcji ze strony Mety. Jak firma tłumaczy swoje działania, odmawiając przy tym podania danych dotyczących Polski.

- Jakie konkretne zmiany postulują eksperci i instytucje publiczne, by skuteczniej chronić użytkowników przed cyfrowymi oszustwami.

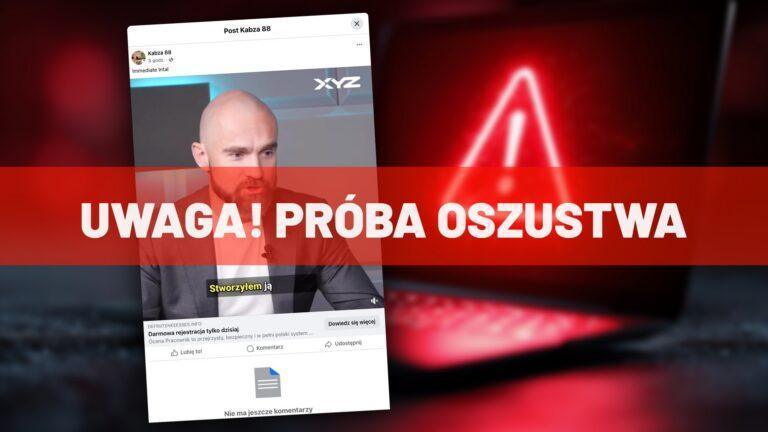

W październiku 2024 r. opisaliśmy historię doktora Michała Sutkowskiego. Znany lekarz przez ponad rok walczył z przestępcami, którzy wykorzystywali jego wizerunek do tworzenia fałszywych reklam produktów, takich jak lek na cukrzycę. Bez skutku. Nowe reklamy trafiały przede wszystkim na Facebook, medium społecznościowe należące do amerykańskiego koncernu Meta. Historia doktora dziś nie szokuje, bo pokrzywdzonych są już tysiące.

Politycy, lekarze, dziennikarze, przedsiębiorcy czy influencerzy regularnie skarżą się, że ich twarze reklamują produkty lub usługi, które możemy nazwać oszustwami.

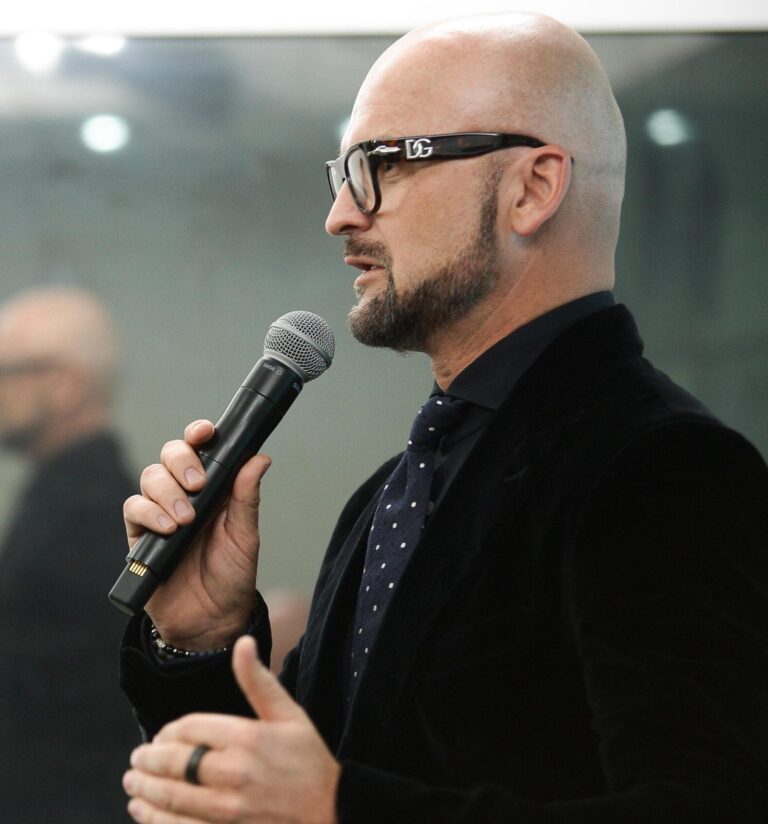

– Na Instagramie jedynym wyjściem okazało się wykupienie płatnej weryfikacji profilu. Dopiero wtedy problem zniknął. Brzmi to, jak klasyczna praktyka mafijna: opłata za ochronę – opowiada o swoich doświadczeniach Jacek Kłosiński, ekspert świata mediów społecznościowych.

Opłata za ochronę, czyli pokrzywdzeni przez oszustów

Jacek Kłosiński to znany trener popularny także w influsferze. Na Facebooku obserwuje go 20 tys. osób. Na Instagramie prawie 17 tys. Stał się ofiarą scamerów.

– Obserwując moją sytuację, ale też innych znajomych twórców, widzę, że problem podszywania się w social mediach to coraz większy kłopot. Od lat nie jest rozwiązywany przez platformy. Choć nie jestem celebrytą, moje profile obserwuje kilkadziesiąt tysięcy osób, co sprawiło, że stałem się celem oszustów. Schemat jest prosty. Przestępca zakłada profil wyglądający jak mój. Następnie w moim imieniu pisze do moich obserwatorów. Zazwyczaj z propozycjami inwestycji w kryptowaluty. Dokładnie ten sam mechanizm działa od lat na profilach wielu innych twórców – tłumaczy Jacek Kłosiński.

Żali się, że reakcja platform społecznościowych jest zdecydowanie niewystarczająca.

– Pomimo wielu zgłoszeń od moich obserwatorów i ode mnie, platformy nie robią z tym zupełnie nic. Platforma zajmuje się sprawą tylko wtedy, gdy za to płacisz. Kiedy dla testu przestałem płacić, problem wrócił błyskawicznie – dodaje Jacek Kłosiński.

Jego historia jest tylko wierzchołkiem góry lodowej. Próbuje okiełznać ją NASK.

Skala coraz większa, NASK interweniuje

Skala tych zjawisk przybiera na sile. Niestety, wbrew deklaracjom platform społecznościowych, w Polsce wciąż mamy ogromny problem.

– Skala i tempo pojawiania się oszustw, w tym kampanii wykorzystujących wizerunki osób publicznych oraz znanych osób nadal wyraźnie przewyższają realną skuteczność mechanizmów wykrywania i wczesnego usuwania takich treści przez platformy. Obserwujemy bardzo dużą dynamikę niepożądanych działań. Tylko w jednym miesiącu zidentyfikowaliśmy ponad 12 tys. przypadków oszustw oraz powielanych materiałów wykorzystujących wizerunki znanych osób – tłumaczy nam Ewelina Bartuzi Trokielewicz, kierowniczka Zakładu Analiz Audiowizualnych i Systemów Biometrycznych w NASK-u.

Problem jest poważny. Jak skarżą się zarówno przedstawiciele NASK, jak i eksperci, z którymi rozmawiamy, działania Mety są co najmniej niewystarczające.

Facebook, Instagram i tysiące zignorowanych zgłoszeń

W Polsce tematami wykorzystywania platform sprzedażowych do oszustw zajmuje się kilka instytucji. Główną jest NASK, a dokładniej Ośrodek Analizy Dezinformacji. Jednym z jego zadań jest podejmowanie działań w zakresie walki ze zmanipulowanymi albo szkodliwymi reklamami umieszczonymi na platformach społecznościowych.

– Ośrodek Analizy Dezinformacji (OAD) NASK ma wyznaczone przez Metę punkty kontaktowe, przez które realizowana jest doraźna komunikacja. Na co dzień przy obsłudze incydentów dezinformacyjnych oraz reklam zawierających deepfake’i wykorzystujemy dedykowane narzędzie. Chodzi o platformę zgłoszeniową udostępnianą przez serwis do rejestracji materiałów i treści, które naruszają regulamin platformy lub polskie prawo. W przypadku spraw, którym należy nadać priorytet, każdorazowo kontaktujemy się bezpośrednio także z punktem kontaktowym – wyjaśnia dr Agnieszka Lipińska, kierowniczka Ośrodka Analizy Dezinformacji NASK.

Oto dane za 2025 r. OAD przesłał do Mety dokładnie 9094 zgłoszeń.

– 4 369 (48 proc.) zostało uznane przez Metę za zasadne i usunięto 3 607 (40 proc.) z nich, a 762 (8 proc.) poddano moderacji. Pozostałe 4 725 (52 proc.), które oceniliśmy jako niezgodne z regulaminem platformy lub polskim prawem, zostały odrzucone przez moderację Mety. Za odrzucone uznajemy zgłoszenia, na które otrzymaliśmy negatywną odpowiedź w systemie bądź pozostały bez żadnej reakcji platformy – deklaruje Izabela Jarka, kierowniczka Zespołu Szybkiego Reagowania i Wykrywania Dezinformacji.

NASK udostępnił naszej redakcji dokładne statystyki z podziałem na kwartały:

Meta nie zgadza się z tezami

Zapytaliśmy firmę Meta o to, dlaczego większość zgłoszeń dotyczących dezinformacji albo manipulacji przekazywanych przez zespoły polskich instytucji publicznych jest, albo nieuwzględniana, albo ignorowana. Biuro prasowe Mety w odpowiedzi na pytanie (firma prosiła, by nie cytować konkretnych osób) stwierdziło, że nie może zgodzić się z takim stwierdzeniem. W komentarzu wskazano, że zgłoszenia instytucji publicznych są traktowane poważnie i rozpatrywane zgodnie z obowiązującymi procedurami.

Zapytaliśmy także o to, czy Meta stawia własny regulamin wyżej ponad interpretację przepisów przez polskich urzędników lub pracowników instytucji publicznych. A także o granice tego, co można uznać za naruszenie regulaminu w przypadku zgłoszenia przez powyższe osoby. Firma nie udzieliła odpowiedzi wprost, ale opisała procedurę postępowania. Jej fundamentem ma być ocena zgodności zgłoszenia ze „Standardami Społeczności”. Jeśli treść je narusza, jest usuwana. Jeśli nie, ale może potencjalnie łamać lokalne prawo, Meta twierdzi, że przeprowadza analizę pod kątem prawnym.

Problemy także w innych obszarach

Funkcjonowanie OAD oraz procedura zgłoszeń o nieprawidłowościach w systemie Mety to jedno z narzędzi, którym dysponuje NASK.

– W NASK-u działają też inne zespoły, które zgłaszają treści do Mety. Przez rok w ramach działań Dyżurnetu – Działu Reagowania na Nielegalne Treści w Internecie (szczególnie związanych z seksualnym wykorzystywaniem dzieci) – przesłano do Mety ok. 100 zgłoszeń. Zgłaszane materiały były dostępne na Facebooku i Instagramie – dodaje Agnieszka Lipińska.

Niestety, jak zaznaczają przedstawiciele NASK-u, zgłoszenia były w zdecydowanej większości klasyfikowane jako treści, które nie naruszają regulaminu ani standardów społeczności.

– Natomiast jako przykład pozytywnej reakcji platformy należy wspomnieć sprawę szonpatroli. Profile po zgłoszeniach bardzo sprawnie były usuwane z Instagrama – zauważa Agnieszka Lipińska.

Ponadto tylko w grudniu 2025 r. CERT Polska (działający w ramach NASK-u) wpisał na Listę Ostrzeżeń ponad 16 tys. domen, które reklamowały fałszywe platformy inwestycyjne, podszywając się pod popularne portale informacyjne.

– W dużej części były to strony reklamowane za pośrednictwem platform społecznościowych – zaznacza przedstawicielka NASK-u.

Z taką sytuacją zetknęła się także nasza redakcja. W styczniu br. w internecie pojawiło się nagranie, w którym Sebastian Kulczyk w studiu XYZ zachęca do inwestowania na swojej platformie inwestycyjnej. Oczywiście było to jawne fałszerstwo. Po naszym bezpośrednim zgłoszeniu do zespołu Mety, reklama została szybko usunięta. Oficjalna ścieżka bazująca na funkcji „zgłoś post” zakończyła się jednak uznaniem reklamy przez automat jako zgodnej ze standardami.

Problem robi się poważny

Tezy NASK-u potwierdzają także eksperci świata mediów społecznościowych.

– Problem zdecydowanie narasta i ewoluuje. Scamy stają się coraz bardziej wyrafinowane dzięki wykorzystaniu AI. Przykładowo – deepfake’i wideo i klonowania głosu. To drastycznie obniża barierę wejścia dla oszustów i zwiększa wiarygodność fałszywych ofert. Jest tego dużo, a będzie coraz więcej – komentuje Wojtek Kardyś, ekspert świata social mediów i współtwórca Fundacji Rzeczypospolita Cyfrowa.

– To nie jest już tylko problem, lecz prawdziwa cyfrowa pandemia. Mamy do czynienia z wręcz lawinowym wzrostem liczby zagrożeń – zauważa Dagmara Pakulska, ekspertka i trenerka świata social mediów, wykładowczyni AGH.

Przykładowo w 2024 r. liczba incydentów dotyczących cyberbezpieczeństwa w Polsce przekroczyła 100 tys. To o prawie 30 proc. więcej niż rok wcześniej. Jak zaznacza Dagmara Pakulska, liczby to jedno.

– Według mnie najgorsza jest zmiana jakościowa. Jeszcze niedawno scamy w mediach społecznościowych kojarzyły nam się głównie z „nigeryjskim księciem” i łamaną polszczyzną wynikającą z nieumiejętnie używanego translatora Google. Dziś mamy erę generatywnej sztucznej inteligencji, a cyfrowi oszuści weszli na poziom Hollywood. Najbardziej niebezpiecznym trendem są deepfake’i i wideo wykorzystujące wizerunki znanych osób [np. Rafała Brzoski czy Omeny Mensah – red.], gdzie z pomocą ich głosu i mimiki zachęcają do „inwestycji życia”. To potrafi uśpić czujność nawet prawdziwych cyfrowych tubylców – dodaje ekspertka.

NASK i CERT kontra Meta, czyli „Nie obserwujemy trendu spadkowego”

W grudniu 2024 r. CERT opublikował komunikat, w którym postulował wprowadzenie kilku rozwiązań w ramach platform należących do Mety. Dzięki nim moglibyśmy liczyć na poprawę bezpieczeństwa użytkowników na terenie Polski. Postulowano m.in. zatrudnienie polskojęzycznych moderatorów czy blokowanie kont, na których wielokrotnie publikowano fałszywe treści. CERT chciał także wdrożenia sprawniejszego mechanizmu blokowania samych treści. Kilka miesięcy później, w marcu 2025 r., CERT podało, że zdecydowana większość postulatów nie została zrealizowana.

Od tego momentu zmieniło się niewiele.

– Użytkownicy nieustannie zgłaszają nam fałszywe platformy inwestycyjne i inne oszustwa promowane z pomocą mechanizmów reklamowych platform społecznościowych. Na platformie wciąż powszechne są reklamy bezprawnie wykorzystujące wizerunek lekarzy, polityków, popularnych celebrytów czy dziennikarzy. Nie obserwujemy trendu spadkowego, jeśli chodzi o takie treści. Pomimo deklaracji firmy Meta odnośnie zastosowania m.in. mechanizmów sztucznej inteligencji do lepszego wykrywania tzw. celeb-bait – zauważa Karol Bojke, ekspert CERT Polska, działającego w ramach NASK-u.

Brak moderacji jest, zdaniem Wojtka Kardysia, jednym z największych grzechów platform społecznościowych.

– Uważam, że nie ma żadnej prawdziwej moderacji. Bo jak inaczej można nazwać to, co oferują big techy?! Przypomnę Facebook, z którego w Polsce korzysta 26 mln osób, a ma 65 moderatorów. Na cały kraj. X nie lepiej, bo dwóch! Dlatego reakcje na zgłoszenia użytkowników są bardzo powolne. Poza tym big techy mają model biznesowy oparty na zasięgach reklamowych. Sprawia on, że platformy dopuszczają do emisji płatne, niesprawdzone kampanie będące oczywistymi wyłudzeniami – dodaje Wojtek Kardyś.

Meta i reakcja na problem

Zwróciliśmy się do firmy Meta z prośbą o odpowiedź na szereg pytań związanych z kwestią współpracy z NASK-iem. Zapytaliśmy także o działania związane z walką z oszustwami i łamaniem standardów społeczności.

Jak wynika z odpowiedzi przesłanej przez biuro prasowe Meta, firma „pozostaje w stałym kontakcie z NASK-iem i zespołami CERT. To długofalowa współpraca, której celem jest rozwój działań w walce z oszustwami oraz zwiększanie bezpieczeństwa w sieci”. Jej realny wymiar to „wymiana informacji”. Przykładowo przez kanał informacyjny. Ten sam, przez który NASK zgłasza się do Mety z informacjami o problematycznych reklamach.

Przedstawiciele Mety twierdzą, że z determinacją zwalczają oszustwa na platformach. Zapewniają, że nie tolerują fałszywych treści. Zgodnie z danymi, które nam przekazano, w ostatnich 15 miesiącach liczba zgłoszeń użytkowników dotyczących oszukańczych reklam spadła o ponad 50 proc. Od początku 2025 r. usunięto ponad 134 mln reklam, których celem było oszustwo. W I połowie 2025 r. liczba zgłoszeń użytkowników dotyczących oszukańczych reklam typu celeb-bait miała spać o 22 proc. To są jednak dane globalne. Firma nie odpowiedziała o pytanie dotyczące danych tylko Polski.

Jak działają oszustwa

Co ciekawe, NASK ma konkretne obserwacje, które mogłyby przyczynić się do poprawy standardów w polskim internecie. Przykładowo, treści wykorzystujące wizerunki znanych osób (przypomnijmy, NASK w ciągu miesiąca identyfikuje kilkanaście tysięcy takich sytuacji), mają bardzo określony model działania.

– Treści te są cyklicznie publikowane, rotują w ekosystemie reklamowym, następnie są usuwane po kilku godzinach. Po czym w krótkim czasie pojawiają się ponownie. Często w zmodyfikowanej formie, a rekordowe kampanie są odtwarzane w tysiącach egzemplarzy – komentuje Ewelina Bartuzi Trokielewicz z NASK-u.

Jak zaznacza ekspertka, taki mechanizm wskazuje na systemowy charakter problemu.

– Pomimo wdrażania przez platformy określonych narzędzi moderacyjnych i procedur reagowania, obecne mechanizmy nie są dostosowane do tempa, skali oraz kreatywności metod stosowanych przez podmioty stojące za oszustwami. Moderacja ma wciąż w dużym stopniu charakter reaktywny, a nie prewencyjny – dodaje Ewelina Bartuzi Trokielewicz.

Meta nie zgadza się z taką tezą. Zgodnie z oświadczeniem biura prasowego firmy, Meta „nie działa wyłącznie reaktywnie”. Firma inwestuje w nowe technologie, współpracuje z ekspertami i partnerami z innych firm, aby, jak oświadcza, użytkownicy czuli się bezpiecznie.

Media społecznościowe prowadzą działania pozorne

Przedstawiciele NASK-u zwracają uwagę, że w ostatnich miesiącach widać jedną pewną poprawę w podejściu Mety do działań przestępców na platformie. Przykładowo, można zaobserwować szybsze reakcje na zgłoszenia czy czasowe intensyfikowanie egzekwowania zasad w wybranych regionach.

– Trudno uznać je za trwały i systemowy przełom. Dodatkowo, jak pokazują m.in. ustalenia śledztwa Reutersa, działania te bywają podporządkowane ograniczaniu presji regulacyjnej, a nie realnemu uszczelnieniu systemu reklamowego na poziomie globalnym. Zamiast wdrożyć globalne zmiany, platformy uruchomiły intensywniejsze działania egzekucyjne tam, gdzie była presja. Jednocześnie starają się, aby oszukańcze reklamy były niewidoczne podczas wyszukiwania ich w publicznej przeglądarce. Usuwanie lub ukrywanie takich reklam miało sprawiać wrażenie, że VLOPy radzą sobie lepiej, niż jest w rzeczywistości – zauważa Ewelina Bartuzi Trokielewicz.

Zdaniem przedstawicieli NASK-u, wciąż brakuje skutecznych środków prewencyjnych. Ponadto nie ma transparentnych statystyk związanych z liczbą fałszywych reklam oraz informacji o usuwaniu takich treści. Utrudnia to obiektywną ocenę efektywności zmian na platformach.

Meta, podobnie, jak przy poprzednich wątkach, nie zgadza się z tezą, że dochodzi do ograniczenia widoczności postów lub reklam w wyszukiwarce. Jak deklaruje biuro prasowe firmy, treści mające na celu oszustwo są usuwane.

Biuro prasowe Mety twierdzi także, że dane dotyczące statystyk są udostępniane – czego dowodem mają być odpowiedzi na nasze pytania. Firma publikuje także raporty na temat transparentności, dostępne na jej stronach internetowych.

Platformy przegrywają walkę z oszustwami a tracą przedsiębiorcy

Dagmara Pakulska twierdzi, że walka z oszustwami to nieustająca gra w kotka i myszkę. Niestety, w tej grze platformy są zawsze dwa kroki za oszustami.

– Działania gigantów, takich jak Meta, często mają charakter typowo reaktywny i zdecydowanie nie są wystarczające. Ponadto mamy tu do czynienia z paradoksem, który frustruje każdego marketera w tym kraju. Legalnie działające firmy często tracą konta reklamowe za błahe błędy w grafice czy użycie zakazanego słowa. W tym samym czasie ewidentne scamy żerujące na wizerunkach znanych osób, czy organizacji, wiszą jako reklamy sponsorowane przez długie tygodnie. W ten sposób oszukują użytkowników – zauważa Dagmara Pakulska.

Jacek Kłosiński twierdzi, że sieci społecznościowe wcale mogą nie chcieć rozwiązać problemu. Bo to im się nie opłaca.

– Cała ta sytuacja przynosi im zyski, zmuszając ludzi do płacenia za ochronę. Dopóki platformy nie poniosą za to konsekwencji prawnych i dopóki ktoś odgórnie ich nie zmusi do działania, nie ma co liczyć na to, że same z siebie coś zrobią. Ta czarna strefa funkcjonowania oszustów, naciągaczy, wyłudzaczy przynosi po prostu platformom korzyści, których trudno jest im się pozbyć – tłumaczy Jacek Kłosiński.

Zdaniem eksperta

Platformy wiedzą o nas wiele

Choć platformy społecznościowe dysponują coraz bardziej zaawansowaną moderacją, w starciu z oszustami ich skuteczność wciąż jest ograniczona. Procedury bezpieczeństwa często nie są w stanie nadążyć za tempem, w jakim przestępcy modyfikują i testują nowe metody działania. W Polsce możemy już mówić o masowej skali tego zjawiska – około 36 proc. badanych deklaruje, że w minionym roku padło ofiarą cyberataku lub oszustwa. Do najczęściej wskazywanych przykładów należą phishing oraz podszywanie się pod inne osoby.

Pokazuje to, że nie mamy do czynienia wyłącznie z lukami w moderacji, lecz z szerszym problemem o charakterze systemowym. Im więcej danych gromadzonych jest w jednym ekosystemie, tym poważniejsze stają się konsekwencje każdego incydentu – niezależnie od tego, czy mowa o wycieku danych, ich niewłaściwym wykorzystaniu, czy też opóźnionej reakcji samej platformy.

Z naszych badań w Incogni wynika, że Meta jest najczęściej karaną firmą z branży mediów społecznościowych na świecie za naruszenia przepisów dotyczących prywatności. Sam Facebook wielokrotnie mierzył się z sankcjami za łamanie RODO w Europie oraz licznymi postępowaniami w USA. Obrazuje to, jak wielkim wyzwaniem pozostaje zarządzanie bezpieczeństwem danych w tak rozległych i scentralizowanych strukturach.

W ramach jednego systemu przetwarzane są ogromne zbiory wrażliwych informacji. Te same mechanizmy, które umożliwiają precyzyjne tzw. targetowanie reklam, są również wykorzystywane przez oszustów do personalizacji ataków – sprawiając, że stają się one łudząco podobne do autentycznej komunikacji.

Eksperci postulują kierunek zmian

Wojtek Kardyś zwraca uwagę na konieczność podjęcia bardzo konkretnych działań. Chodzi przede wszystkim o uszczelnienie procesów weryfikacji reklamodawców przed dopuszczeniem reklamy do emisji.

– By to było możliwe, trzeba mocniej docisnąć big techy regulacjami. Niezbędna jest też ściślejsza współpraca platform z organami ścigania oraz systemowe wsparcie edukacji cyfrowej użytkowników, by potrafili samodzielnie identyfikować socjotechnikę. W Polsce czekamy przecież na wdrożenie DSA – dodaje ekspert.

Podobnego zdania jest Dagmara Pakulska.

– Moderacja opiera się na automatach, które nie rozumieją kontekstu kulturowego ani specyfiki polskiego rynku. Co gorsza, co tu dużo kryć, platformy zarabiają na tych reklamach. Dopóki scam nie zostanie zgłoszony [często setki razy przez samych użytkowników! – red.], pieniądze płyną do kasy big techu. Choć platformy deklarują brak intencjonalnego wspierania oszustw, w praktyce model biznesowy oparty na automatycznej sprzedaży reklam powoduje, że do momentu zgłoszenia i zdjęcia kampanii przychody są generowane. To, że prezes UODO i sąd musieli w 2024 r. wydać precedensową decyzję, by fizycznie zakazać Mecie wyświetlania wizerunku Rafała Brzoski i Omeny Mensah, jest aktem desperacji i dowodem na to, że samoregulacja platform po prostu nie działa – podsumowuje Dagmara Pakulska.

Ekspertka postuluje także koniec z anonimowością reklamodawców w mediach społecznościowych.

– Platformy powinny wreszcie wziąć odpowiedzialność za to, komu sprzedają zasięgi. Zwłaszcza w przypadku reklam związanych z usługami finansowymi, powinno się przechodzić bardzo rygorystyczną weryfikację. Obecnie założenie „słupa” reklamowego jest niestety zbyt proste – dodaje Dagmara Pakulska.

Główne wnioski

- Skala oszustw z wykorzystaniem wizerunków znanych osób na platformach Meta w Polsce osiągnęła poziom alarmujący, a działania zaradcze firmy są oceniane jako niewystarczające. W 2025 r. Ośrodek Analizy Dezinformacji NASK skierował do Mety ponad 9 tys. zgłoszeń dotyczących szkodliwych reklam. Połowa z nich została odrzucona lub pozostała bez odpowiedzi. Eksperci alarmują, że systemy moderacji Facebooka i Instagrama nie nadążają za tempem i skalą oszustw, które coraz częściej wykorzystują technologie AI, w tym deepfake'i i klonowanie głosu.

- Meta kwestionuje zarzuty, twierdząc, że działa zgodnie z procedurami i inwestuje w bezpieczeństwo, lecz brak transparentnych danych dla Polski utrudnia ocenę skuteczności tych działań. Firma deklaruje, że globalnie usunięto miliony reklam i liczba zgłoszeń użytkowników maleje, ale nie podaje danych dla Polski. Równocześnie Meta odmawia odpowiedzi na pytania dotyczące hierarchii między lokalnym prawem a własnym regulaminem. Budzi to wątpliwości co do priorytetów platformy w kontekście krajowych realiów.

- Eksperci i instytucje postulują konieczność zaostrzenia regulacji oraz wprowadzenia skuteczniejszych mechanizmów kontroli reklamodawców. Propozycje obejmują m.in. obowiązek rygorystycznej weryfikacji reklam finansowych, zatrudnienie polskojęzycznych moderatorów oraz większą przejrzystość działań platform. Wskazuje się na problem strukturalny: dopóki oszukańcze reklamy nie zostaną zgłoszone, generują przychody, a obecny model oparty na automatyzacji i słabej moderacji sprzyja nadużyciom.

Napisaliśmy o tym, bo uznaliśmy to za ważne i ciekawe. Dla pełnej transparentności informujemy, że fundusz RiO, należący do Omeny Mensah i Rafała Brzoski, prezesa i akcjonariusza InPostu, jest inwestorem w XYZ.