Nowy wstrząs dla branży elektroniki. Przez niedobory wafli krzemowych nadchodzą duże podwyżki cen (WYWIAD)

„To naprawdę największe zamieszanie w branży od 30 lat” – mówi w rozmowie z XYZ.pl Dariusz Piotrowski, dyrektor generalny Dell Technologies Polska. Wszystko przez ogromne niedobory wafli krzemowych. Są wszędzie – od zegarków, przez lodówki, aż po wielkie centra danych. Czekają nas ogromne podwyżki cen elektroniki – przestrzega.

Z tego artykułu dowiesz się…

- Dlaczego globalny rynek pamięci komputerowych znalazł się w bezprecedensowym kryzysie i co wspólnego mają z tym inwestycje w sztuczną inteligencję oraz gigantyczne centra danych.

- Jak rosnące ceny komponentów i opóźnienia w dostawach wpływają na firmy, budżety IT oraz dostępność sprzętu, z którego korzystamy na co dzień

- Jakie zmiany może wywołać obecna sytuacja w rozwoju technologii, w tym czy mniejsze, lokalne rozwiązania AI mogą zyskać przewagę nad wielkimi projektami infrastrukturalnymi

Grzegorz Nawacki, Cezary Szczepański, XYZ: Czy naprawdę firmy, które kupują sprzęt komputerowy, muszą właśnie przepisywać budżety?

Dariusz Piotrowski, dyrektor generalny Dell Technologies Polska: Budżety, a czasem nawet całe plany finansowe na ten rok.

Dlaczego?

Z powodu znaczącego wzrostu cen kości pamięci. To nie jest chwilowe załamanie popytu. Mówimy o ogromnych brakach w dostępności komponentów, które znajdują się absolutnie wszędzie – w serwerach, komputerach, samochodach czy smart-lodówkach.

Z czego to wynika?

Ponad 85 proc. rynku kontroluje trzech dużych graczy. Kiedy wybuchła pandemia COVID-19, skokowo zwiększyli oni moce produkcyjne, bo popyt był ogromny. Po pandemii popyt mocno spadł, podobnie jak produkcja. I dość niespodziewanie, mniej więcej od połowy 2025 r., nastąpił nagły, bardzo silny wzrost popytu na kości pamięci. To swoisty „perfect storm”, który uderzył w branżę IT. Sytuacja jest naprawdę gwałtowna.

Brakuje kości pamięci, ceny wzrosną

Na czym polega istota problemu?

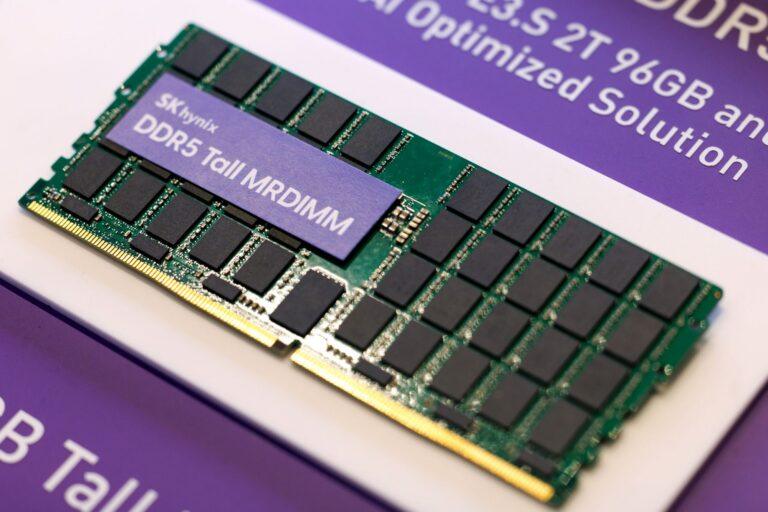

Otóż do dostawców takich jak my – i do wielu innych firm – zaczęły spływać zamówienia na budowę gigantycznych centrów danych przeznaczonych dla sztucznej inteligencji. Mówimy tu o projektach liczonych w dziesiątkach, a nawet setkach miliardów dolarów. Kluczowym komponentem nowoczesnych centrów danych – obok procesorów graficznych Nvidii i innych producentów – są dziś pamięci HBM. Co się więc wydarzyło? Producenci, mając pewne i ogromne zamówienia na najbardziej zaawansowane, a zarazem najwyżej marżowe pamięci, zdecydowali się przesunąć moce produkcyjne właśnie w tym kierunku. Tam mogą więcej zarobić i tam mogą podnosić ceny. Efektem są coraz większe niedobory w średnim i niższym segmencie rynku. Zaczęliśmy to obserwować mniej więcej pod koniec października i w listopadzie. W grudniu sytuacja była już trudna.

I nadal trwa?

Tak, to nie jest chwilowa anomalia. Przez ostatnie 30 lat rynek pamięci oczywiście podlegał wahaniom. Bywały nawet okresy spadków cen – tak duże, że taniał także sprzęt komputerowy. Dziś sytuacja jest dokładnie odwrotna. A pamięci są dziś wszędzie: w telefonach, tabletach, samochodach, inteligentnych lodówkach. Współczesna elektronika jest nimi dosłownie wypełniona. Dlatego problem nie dotyczy tylko branży IT. W kolejce po pamięci ustawiły się właściwie wszystkie branże.

Problem ma skalę globalną

O jakiej skali problemu mówimy?

Szacunki firm analitycznych wskazują, że przy obecnym popycie rynek jest w stanie zaspokoić jedynie około 70 proc. zapotrzebowania. Co ważne, ta luka ma długotrwałe konsekwencje, bo kolejka zamówień się wydłuża, a do obecnego popytu dochodzą zaległości z poprzednich miesięcy. Wszystko zaczyna się na siebie nakładać.

Jakie są skutki tej sytuacji?

Przede wszystkim radykalne podwyżki cen pamięci. We wszystkich segmentach rynku. Nie mogę podać dokładnych liczb, bo sytuacja zmienia się dosłownie z dnia na dzień. Obecnie widzimy wzrosty cen niektórych kości pamięci na poziomie kilkudziesięciu procent w porównaniu z poprzednim miesiącem.

Trzeba też jasno powiedzieć: jeśli drożeje kość pamięci w jakimkolwiek urządzeniu IT, to drożeje całe urządzenie. Wszystko zależy od tego, jak duży udział ma pamięć w całym zestawie komponentów.

O ile wzrosną ceny elektroniki?

Jaki jest udział tej ceny w standardowym komputerze?

W przybliżeniu od kilkunastu do około 20 proc. wartości całego urządzenia. W serwerach jest to jeszcze więcej – około 30 proc., a czasem nawet więcej. Pamięć jest tam jednym z kluczowych elementów.

Jest też druga konsekwencja, czyli przesunięcia w terminach dostaw. Obecnie niektóre firmy raportują opóźnienia na poziomie sześciu czy dziewięciu miesięcy. Nasz łańcuch dostaw jest odporny i globalnie zróżnicowany. Zaprojektowaliśmy go tak, aby zapewnić niezbędną elastyczność w sytuacjach wielu wyzwań makroekonomicznych, regulacyjnych i handlowych.

Czyli niezależnie od wszystkiego kości i tak trafiają do Della?

W pewnym sensie tak. I to jest zasadnicza różnica w porównaniu z mniejszymi dostawcami, którzy oferują jeden czy kilka produktów i nagle muszą ustawić się w kolejce. My planujemy nasze zapotrzebowanie z dużym wyprzedzeniem. Dlatego, pomimo że sytuacja jest trudna dla całego rynku, my czujemy się stosunkowo bezpiecznie. Oczywiście takie zaburzenia rynkowe nigdy nie są dobre. Wolelibyśmy stabilny, przewidywalny wzrost rynku. Ale obecna sytuacja potrwa jeszcze jakiś czas, zanim się unormuje.

Dwa lata do zmiany sytuacji

Kiedy to może nastąpić?

Nawet jeśli ktoś dziś zdecydowałby się zainwestować w nową fabrykę pamięci, to od momentu rozpoczęcia budowy do uzyskania pełnych mocy produkcyjnych mija zwykle od 18 do 24 miesięcy. To oznacza, że obecne strukturalne zaburzenie rynku potrwa co najmniej dwa lata – o ile w ogóle pojawią się inwestorzy gotowi zbudować nowe moce produkcyjne i konkurować z trzema gigantami, którzy działają na tym rynku od dziesięcioleci. To nie jest produkcja plastikowych krzeseł, którą można szybko uruchomić. Mówimy o technologii najwyższej klasy.

Dlatego jedną z najważniejszych informacji dla firm jest to, że tej sytuacji nie da się po prostu przeczekać. Spotykałem się z wieloma członkami zarządów i dyrektorami IT, którzy mówili: „Poczekamy trzy miesiące i wrócimy do naszych projektów”. Niestety, to tak nie zadziała.

Co można zrobić?

To jest moment na poważną rewizję planów IT – zarówno pod względem budżetów, jak i harmonogramów projektów. Wcześniej firmy zakładały, że sprzęt przyjedzie w dwa miesiące, potem uruchomi się oprogramowanie, a po pół roku projekt będzie w produkcji. Dziś może się okazać, że już pierwszy etap się opóźni, bo sprzęt przyjedzie dopiero za sześć czy osiem miesięcy. W efekcie cały projekt może zakończyć się dopiero w przyszłym roku.

Przetargi pod presją nowych cen

Jak to wpływa na większe przetargi?

Trzeba uwzględnić nową rzeczywistość. Przykładowo warto skracać czas wyboru ofert, opcjonalnie tworzyć bardziej elastyczne konfiguracje sprzętu, bo brakuje określonego typu pamięci. Warto też prowadzić dialog z dostawcami i pytać o możliwe zamienniki danej konfiguracji. No i oczywiście trzeba inaczej planować budżety.

A jak bardzo ceny mogą jeszcze wzrosnąć? Jeśli budowa nowej fabryki trwa około dwóch lat, to przecież opóźnienia będą się kumulować przez długi czas.

Razem z naszym zarządem w Austin i głównymi osobami w firmie odpowiadamy na to pytanie bardzo uczciwie: nie wiemy. Jeśli oni tego nie wiedzą, to tym bardziej ja nie wiem – i nie wie tego cały rynek.

Oczywiście można sobie wyobrazić scenariusz, w którym świat reaguje na wysokie ceny i popyt zaczyna spadać. Ekonomiści powiedzieliby, że tak właśnie powinno się stać.

Przez 30 lat rynek funkcjonował dość stabilnie – czasem pojawiał się chwilowy skok popytu. Dziś jesteśmy w sytuacji bezprecedensowej. Jestem na rynku od ponad 30 lat i nigdy nie widziałem takiej dynamiki zmian i tak trudnych negocjacji. Część klientów nie rozumie tej sytuacji. Niektórzy podejrzewają, że to celowe działania producentów, żeby podnieść ceny. To strukturalna zmiana na rynku IT i będzie ona dotyczyć wszystkich.

Problem dla inwestorów dużych centrów danych

Pamiętam sytuację sprzed kilku lat, kiedy firmy budujące centra danych licytowały się na moce produkcyjne. Pytanie, czy teraz też tak będzie i czy duża konkurencja – która również ma długoterminowe kontrakty – nie zacznie was mocniej podgryzać przy budowie dużych data center?

Teraz zobaczymy to jak w soczewce. Najtrudniej będzie dostarczyć duże centra danych, bo zamówienia będą gigantyczne. Dostarczenie dziesięciu serwerów do prywatnego podmiotu wielu graczy będzie jeszcze w stanie zrealizować. Ale dostarczenie 50 tys. kart GPU w serwerach chłodzonych cieczą, zamontowanych i przywiezionych, gdzie wszystkie wymagają pamięci – to już zadanie, któremu niewielu będzie w stanie sprostać.

Jeśli chodzi o ceny, to największy problem będzie dotyczył raczej tańszej elektroniki użytkowej?

Nie, ten problem dotyczy wszystkich zamówień – zarówno serwerów, jak i komputerów osobistych. Chodzi jednak o to, że tam, gdzie marże są wyższe, produkcja zostanie w pierwszej kolejności przeniesiona właśnie do tych segmentów. W efekcie największe braki będą widoczne w najtańszych produktach. Z drugiej strony udział pamięci w kosztach całego rozwiązania jest w takich przypadkach relatywnie niewielki, więc podwyżki – w relacji do najbardziej zaawansowanych systemów – będą trochę mniejsze.

Już teraz obserwujemy różne ciekawe zjawiska. Na przykład zwiększyła się liczba osób kupujących stare komputery na portalach sprzedażowych.

W celu pozyskania kości pamięci?

Tak. Kupując sprzęt, trzeba zwracać uwagę, czy nie ma gdzieś gwiazdki i informacji: „bez kości pamięci”.

Ceny sprzętu Dell

Czy ta sytuacja wpływa też na waszą politykę cenową?

Oczywiście. My również, w uzasadnionych przypadkach, podejmujemy ukierunkowane działania cenowe. Wszystko trzeba dziś ciągle przeliczać. To proces nieustanny. I dlatego automatyzacje wdrażane wewnętrznie w Dellu są tak ważne. Ci, którzy tego nie zrobią, będą zawsze tydzień, dwa albo miesiąc spóźnieni z reakcją.

Ale czy to nie tworzy trochę samonapędzającej się bańki? Skoro spodziewacie się, że za miesiąc ceny mogą wzrosnąć o 20 proc., to już dziś sprzedajecie drożej?

Nie. Mamy wytyczne dotyczące marży na dziś i ważności oferty na dziś. To musi się zgadzać w bieżącym miesiącu. Jeśli przyjdzie podwyżka, wtedy pojawi się nowe wyliczenie. Marża nie rośnie – rosną koszty. My utrzymujemy marżę na tym samym poziomie, ale cena końcowa dla klienta wzrasta.

Czy można zmienić sytuację

A dlaczego tylko te trzy firmy produkujące pamięci nie zwiększą po prostu mocy produkcyjnych?

Są tu dwa czynniki. Po pierwsze, zwiększenie mocy nie jest ani proste ani szybkie – wymaga czasu i dużych nakładów. Po drugie, obecna sytuacja ma dla producentów wymiar rynkowy. W czasie pandemii notowali wysokie przychody, później ograniczali produkcję wraz ze spadkiem popytu, a dziś próbują odbudować wyniki. To jednak pytanie przede wszystkim do nich.

Czyli po prostu nie przewidzieli trendów?

Być może.

Widzi pan jeszcze jakieś inne potencjalne punkty zapalne tej skali?

Na ten moment nie. To największe zaburzenie w branży od 30 lat, przynajmniej w obszarze sprzedaży i dostępności komponentów. Trudno wskazać wcześniejszą sytuację, która jednocześnie objęłaby wszystkie segmenty rynku. Pomijam pęknięcie bańki internetowej czy kryzys po upadku Lehman Brothers – miały inny charakter.

Czyli nie ma sposobu, żeby to obejść?

Nie.

Komputery AI i przyszłość gospodarki

Patrząc szerzej – czy te problemy nie spowodują spowolnienia trendów, o których mówimy od jakiegoś czasu? Na przykład przejścia na komputery AI?

To możliwe. Wydłużenie czasu realizacji projektów i wzrost kosztów mogą prowadzić do ich odraczania lub ograniczania. Dlatego warto precyzyjnie analizować rzeczywiste potrzeby. W przypadku organizacji posiadających większe zasoby infrastrukturalne zasadne jest sprawdzenie poziomu ich wykorzystania – zarówno w ciągu dnia, jak i w nocy. W wielu firmach nadal istnieje przestrzeń do optymalizacji, która dotąd nie była wykorzystywana.

Na przykład: w dzień pracujemy na laptopach, a w nocy możemy trenować na nich modele?

Laptop daje ograniczone możliwości. Większy potencjał mają stacje robocze, które poza godzinami pracy pozostają niewykorzystane i mogą realizować inne zadania. Jednocześnie istnieje ryzyko wydłużania cyklu życia sprzętu. To nie jest korzystne – wymiana urządzeń wiąże się z dostępem do nowszych, bezpieczniejszych rozwiązań, lepiej przygotowanych na nowe typy zagrożeń.

Opóźnienia na horyzoncie

Jeśli zakładamy, że moce w centrach danych muszą dramatycznie rosnąć żeby trenować modele czy budować suwerenną AI na poziomie państw i firm. A tu nagle okazuje się, że sprzętu brakuje albo jest bardzo drogi, to część projektów może się opóźnić.

Może to jednocześnie przyspieszyć rozwój Edge AI. W wielu zastosowaniach wystarczą mniejsze, lokalne modele, które można uruchamiać nawet na relatywnie niewielkich urządzeniach, bez konieczności korzystania z dużych centrów danych. To otwiera przestrzeń dla rozwoju mniejszych modeli, takich jak polski Bielik. Dane pozostają lokalnie, a koszt wdrożenia może być relatywnie niski.

Czyli obecna sytuacja może mieć też pozytywne konsekwencje?

Tak. Duże centra danych mogą powstawać wolniej, ale jednocześnie rośnie znaczenie rozwiązań lokalnych, które wymagają mniej zasobów i mogą być tańsze. Sprzęt kupuje się jednorazowo i wykorzystuje lokalnie. Edge AI staje się istotnym kierunkiem rozwoju. Kluczowa jest zasada przetwarzania danych jak najbliżej miejsca ich powstania.

Administracja i nowe wyzwania

A czy taka zmiana jest też widoczna w administracji publicznej, jeśli chodzi o dyskusję o AI?

Jak najbardziej.

Pytam, bo chociażby niedawno była konferencja prasowa, na której ministrowie: obecnego i poprzedniego rządu, opowiadali o suwerennej AI i o tym, że trzeba ją budować. Tylko że sama konferencja była w zasadzie finansowana przez Google, więc pojawiły się wokół tego pewne kontrowersje.

Suwerenność niejedno ma imię. To bardzo ciekawa narracja. W tym kontekście istotne jest rozwijanie rozwiązań lokalnych, które zwiększają kontrolę nad danymi i demokratyzują dostęp do technologii. Projekty takie jak Bielik są przykładem tego trendu. Skala zainteresowania jest duża – w jednym z konkursów otrzymaliśmy 630 zgłoszeń, znacznie więcej niż zakładano. Wskazuje to na istotny potencjał rozwoju ekosystemu Edge AI.

My sami teraz zastanawiamy się, co zrobić z tym ekosystemem, jak go przeanalizować, pogrupować i rozwijać, bo skala odpowiedzi naprawdę nas zaskoczyła.

Zmiana kierunku Della

To może prowadzić do budowy platformy usług AI?

Tak. Pokazuje to potencjał lokalnych rozwiązań i ich znaczenie dla budowy suwerenności technologicznej. Jeśli projekty zostaną odpowiednio rozwinięte i dofinansowane, mogą znaleźć zastosowanie w administracji, ochronie zdrowia i biznesie.

Czy Dell ma ambicję, żeby wyjść poza ramy producenta sprzętu?

Takie działania są realizowane od lat. Budujemy ekosystem rozwiązań. Nie tworzymy aplikacji końcowych, ale rozwijamy oprogramowanie dla naszych urządzeń, które stają się coraz bardziej zaawansowane. Posiadamy również zaplecze R&D i planujemy jego dalszy rozwój.

Koniec z chmurą?

Czy to oznacza odejście od modelu chmurowego?

Nie. Rozwiązania chmurowe pozostają istotnym elementem rynku. Równolegle rośnie znaczenie rozwiązań lokalnych i edge. Ten kierunek był widoczny już kilka lat temu, jeszcze przed popularyzacją pojęcia Edge AI. Obecnie potwierdzają to również działania największych dostawców usług chmurowych.

Model docelowy to współistnienie różnych podejść: chmury, edge oraz rozwiązań hybrydowych. Teza, że jedno z nich całkowicie zdominuje rynek, nie znajduje potwierdzenia w praktyce.

Był chyba taki moment, że każdy, kto kwestionował tezę, iż wszystko przejdzie do chmury, uchodził za boomera.

Wielu tak mówiło i to była zła narracja, bo opierała się na kwantyfikatorze ogólnym: „wszystko przejdzie do chmury”. A taki kwantyfikator z definicji prawie zawsze jest błędny. Nie przypominam sobie żadnej technologii, odkąd żyję, w odniesieniu do której można by było użyć takiego określenia „w 100 proc.”

Pamiętacie hasło „PC is dead”? Przez lata się nim straszono. A tymczasem telefony działają, tablety nadal są z nami, a komputery mają się dobrze. Ja wierzę w koegzystencję. Ten rynek rośnie jak ciasto. To nie jest sytuacja „albo to, albo tamto”.

Dell i MON. Gdzie zmierza współpraca?

Niedawno podjęliście współpracę z MON. Chcecie wnieść do niej wyłącznie sprzęt?

To porozumienie, w którym sprzedaż sprzętu jest dopiero na końcu. Na początku najważniejsze jest dzielenie się wiedzą. Na to właśnie się umówiliśmy: wymiana informacji o realizowanych projektach i zastosowaniach, a także danych o podatnościach – tak, żeby szybciej reagować i lepiej komunikować się zarówno z Dowództwem Komponentu Wojsk Obrony Cyberprzestrzeni, jak i z rynkiem.

W obecnych warunkach nawet trend związany z pamięciami jest ważną informacją dla takiego partnera. Wpływa na to, jak planować zakupy i jak wygląda sytuacja w obszarze infrastruktury krytycznej. My również uczymy się od naszego partnera, bo DKWOC realizuje bardzo ciekawe projekty. To realna współpraca w obie strony. Przykładem może być projekt Cyber Legionu, skupiający specjalistów IT. Wśród naszych inżynierów i partnerów widać zainteresowanie udziałem w takich inicjatywach.

Dowództwo Komponentu Wojsk Obrony Cyberprzestrzeni podpisało też podobne umowy z innymi firmami, między innymi z Microsoftem. Gdzie przebiegają granice takich porozumień? Czy w przypadku Della chodzi głównie o wymianę wiedzy, czy jednak macie też konkretne rozwiązania, narzędzia i sprzęt dostarczane do wojska?

Wchodzimy tu w obszar tajemnicy handlowej – co dokładnie dostarczamy i komu. Natomiast nie jest tajemnicą, że Dell jest istotnym dostawcą infrastruktury dla wielu krajów NATO, i to do bardzo różnych zastosowań.

Nasz sprzęt może być odpowiednio wzmacniany, dostosowany do wymagających warunków, analizowany pod kątem odporności elektromagnetycznej i przygotowany do specjalistycznych zastosowań. Takie rozwiązania mamy. Dlatego ta współpraca obejmuje również dostarczanie infrastruktury.

Cyberzagrożenia a polski sektor publiczny

A czy w polskim sektorze publicznym jest świadomość cyberzagrożeń? W końcu od czterech lat mamy wojnę za wschodnią granicą, a Polska jest stale celem cyberataków.

Czym właściwie jest „polski sektor publiczny”? To dziesiątki, setki tysięcy ludzi. Są instytucje, choćby wzorcowe urzędy miejskie, które mają pełną świadomość i robią tyle, ile mogą. Trudno oczekiwać tego samego poziomu przygotowania od wszystkich podmiotów. Jako Dell podejmujemy różne działania wspierające. Przykładowo mamy projekt, który nazywa się „Future Made in Poland”. Wspieramy inicjatywy, które dbają o naszą suwerenność technologiczną. I będziemy to nadal robić. Będziemy zatrudniać ludzi do R&D, rozwijać polską fabrykę, współpracować z Bielikiem i produkować sprzęt w Polsce.

To ciekawy przypadek, bo z punktu widzenia globalnej firmy z silnymi amerykańskimi korzeniami pojawia się pytanie: czy nie ma ryzyka, że któregoś dnia ktoś zadzwoni i powie: „Dell zrobił globalny deal z Samem Altmanem, więc zapomnijcie o Bieliku”?

Nie, to tak nie działa. Dell dostarcza platformę. To, co na tej platformie działa w danym kraju, zależy od klientów. Nie wyobrażam sobie sytuacji, w której ktoś powie: „na tej platformie wolno używać tylko jednego rozwiązania”. To byłoby sprzeczne z naszą strategią od początku istnienia firmy. To tak, jakby powiedzieć, że komputer będzie działał tylko z jedną aplikacją. Dell nigdy czegoś takiego nie zrobił i nie zrobi.

Zresztą to jest właśnie nasza siła. Od dekad jesteśmy technologicznie agnostyczni. Jesteśmy obecni zarówno w prywatnych centrach danych, jak i w rozwiązaniach hybrydowych oraz u największych dostawców usług chmurowych. Nigdy nie twierdziliśmy, że jedno podejście wyklucza inne. Te modele się uzupełniają.

Geopolityka a biznes Della w Polsce

Czy geopolityka może wpływać na sposób działania technologii? Na przykład poprzez decyzje polityczne?

To trochę tak, jakby zakładać, że prezydent zmusi globalnego dostawcę usług chmurowych do wyłączenia usługi w danym kraju. My nie działamy w tym modelu. Serwer kupiony w Polsce i zainstalowany w banku działa tak długo, jak długo bank go używa. Nie mamy możliwości jego zdalnego wyłączenia.

Czy to, co dzieje się w geopolityce, wpływa na wasze plany rozwoju w Polsce? Na przykład na inwestycje w fabrykę czy R&D?

Dell od lat korzysta z rozproszonej sieci produkcji i centrów badawczo-rozwojowych. Bywały sytuacje wymagające szybkiej reakcji, nawet niezwiązane z polityką. Pamiętam przypadek tornada w Stanach Zjednoczonych, które uszkodziło centrum logistyczne. Wtedy fabryka pod Łodzią w ciągu kilkunastu dni zwiększyła produkcję, uruchomiła dodatkowe linie i wysłała sprzęt do USA drogą lotniczą.

Inwestycje Della w Łodzi

W jakim stopniu wykorzystywane są dziś moce produkcyjne w Łodzi?

To się zmienia niemal z dnia na dzień. Pod koniec kwartałów produkcja zwykle rośnie, bo pojawia się więcej zamówień. To powtarzalny schemat. Generalnie poziom wykorzystania zależy od bieżącego popytu.

Czy planujecie dalszą rozbudowę?

Uruchomiliśmy już linie produkcyjne serwerów AI oraz całych zestawów z chłodzeniem cieczą. To zupełnie inny poziom infrastruktury niż klasyczne serwery chłodzone powietrzem. Wymaga instalacji rozbudowanych systemów chłodzenia i specjalistycznych stanowisk testowych. Te inwestycje przygotowują fabrykę na dalszy wzrost. Powstało również centrum logistyczne bezpośrednio przy zakładzie.

Ono już działa?

Tak, działa, choć rozruch odbywa się stopniowo.

Było jakieś oficjalne otwarcie?

Nie organizujemy dużych wydarzeń. Po prostu rozwijamy infrastrukturę i pracujemy dalej. Informacja o rozpoczęciu budowy pojawiła się wcześniej, ale komunikował ją partner realizujący inwestycję.

Co szykuje Dell

A kolejne inwestycje?

Jeśli Michael Dell zdecyduje, to będą.

Czyli jakieś projekty już czekają na biurku?

Firma jest sprawnie zarządzana przez centralę w Austin. My koncentrujemy się na pokazywaniu potencjału Polski. Bez rozwoju działalności i budowania lokalnych kompetencji trudno byłoby uzasadniać kolejne inwestycje.

Pytam o to, bo słychać na rynku głosy, że amerykańskie firmy nie zawsze mogą się chwalić inwestycjami za granicą.

Nie spotkałem się z żadnym takim ograniczeniem.

A Michael Dell i Donald Trump są kolegami?

Nie znam ich relacji. Wiem jedno: Michael prowadzi firmę od ponad 40 lat i współpracował już z wieloma prezydentami Stanów Zjednoczonych. Z każdym utrzymywał relacje, bo rząd USA jest jednym z największych klientów firmy. I tak jest do dziś.

Administracja Trumpa i jej wpływ na świat

Niedawno pojawił się duży konflikt na linii Anthropic – administracja publiczna, dotyczący używania modeli AI do celów wojskowych. Czy takie zjawisko dla Della to w ogóle jest problem?

Istnieje granica odpowiedzialności producenta sprzętu. To pytanie należałoby skierować do twórców modeli – takich jak OpenAI czy Anthropic: jakie mają wartości, jakie granice etyczne wyznaczają, czego chcą, a czego nie chcą wspierać. To bardzo ważna dyskusja we współczesnym świecie, ale nas bezpośrednio nie dotyczy.

Pytam o to też dlatego, że w przypadku Starlinka i Elona Muska było widać, że kwestie sprzętowo-infrastrukturalne również mogą budzić wątpliwości.

Rozumiem, ale u nas tego nie widzę. Mamy jasne wytyczne. Wiadomo, do jakich krajów nie sprzedajemy sprzętu, bo obowiązuje embargo – i to jest nasza granica.

Rekordowe wyniki Della a zwolnienia

Niedawno Dell opublikował wyniki finansowe – rekordowe w skali globalnej. Pamiętam jednak ogłoszenia sprzed roku o dużych zwolnieniach w firmie, sięgających kilkunastu tysięcy osób. Jak te zjawiska się ze sobą łączą i w jakim kierunku zmierza firma?

Chciałbym oddzielić dość naturalny proces – i to nie tylko w Dellu, ale w całej branży IT – czyli redukcję zatrudnienia po okresie dynamicznego wzrostu. W czasie pandemii COVID-19 nastąpił bardzo duży wzrost zatrudnienia, później przyszło uspokojenie i dziś mamy do czynienia raczej z korektą. Jeśli spojrzymy szerzej, wszystkie branże się automatyzują. Coraz częściej korzystają z algorytmów, które usprawniają procesy. To naturalny kierunek – efektywność po prostu rośnie.

Jeśli chodzi o wyniki Della, warto zwrócić uwagę na kilka kwestii. Wzrost przychodów rok do roku wyniósł 19 proc. Jak na naszą branżę i poziom konkurencji, to bardzo dużo. To był bardzo dobry rok dla Della i zakładamy, że kolejny również będzie udany.

Model biznesowy ulega zmianie.

Dell przez 42 lata, odkąd istnieje, był kojarzony przede wszystkim z komputerami. Po raz pierwszy w historii przychody z segmentu PC były niższe niż z pozostałych obszarów – czyli serwerów, centrów danych, pamięci masowych i podobnych rozwiązań. Wzrost w tym drugim obszarze wyniósł około 40 proc., a w segmencie PC spadek wyniósł około 5 proc.

AI to nowy silnik Della?

I to będzie główny silnik Della w przyszłości?

Wzrost na rynku komputerów może odbywać się kosztem konkurencji, ale inaczej wygląda sytuacja w segmencie serwerów i rozwiązań związanych z przechowywaniem danych. Przetwarzamy coraz więcej informacji, pojawiła się sztuczna inteligencja i obserwujemy wyraźne przyspieszenie. Dobrze odnaleźliśmy się w tym obszarze. W samym czwartym kwartale otrzymaliśmy więcej zamówień na serwery i rozwiązania AI niż w trzech poprzednich kwartałach łącznie. Skala wzrostu jest bardzo duża.

Dlatego wyniki Della są obecnie bardzo mocne. Zakładamy, że ten trend się utrzyma, również dzięki projektom wewnętrznym, które zmieniają sposób funkcjonowania firmy i wykorzystują automatyzację oraz zaawansowane algorytmy. Ten proces będzie kontynuowany.

A jak to wygląda w Polsce?

Nie publikujemy danych krajowych. Mogę natomiast powiedzieć, że widzimy wyraźniejszy wzrost w obszarze infrastruktury – podobnie jak w całym Dellu – niż w segmencie komputerów osobistych. Z jednym zastrzeżeniem: w zeszłym roku zrealizowaliśmy duże zamówienia z sektora edukacyjnego. Miały one charakter jednorazowy, więc nie powtarzają się co roku. Po ich wyłączeniu wzrost w segmencie PC byłby stabilny.

Polska kontra świat

A jeśli chodzi o Polskę i rynek serwerowy – czy tutaj też widzicie większe wzrosty w porównaniu z innymi krajami europejskimi?

Na pewno Polska jest beneficjentem środków, które są obecnie wydawane – zarówno z KPO, jak i z innych programów. To pobudziło sektor publiczny, ale nie tylko on ma znaczenie. Jeśli porównamy się z innymi krajami, był to dla nas dobry rok. Z tego, co wiem, w innych dużych krajach Europy również odnotowano bardzo dobre wyniki, więc nie jesteśmy tu żadną wyjątkową wyspą. Najbardziej widać to w segmencie serwerów.

Główne wnioski

- Mamy gwałtowny i strukturalny niedobór pamięci komputerowych, który wynika z nagłego wzrostu popytu napędzanego rozwojem sztucznej inteligencji oraz budową wielkoskalowych centrów danych. Producenci, koncentrując się na najbardziej dochodowych segmentach, takich jak pamięci HBM wykorzystywane w AI, ograniczyli dostępność komponentów dla innych zastosowań. W efekcie rynek jest w stanie zaspokoić jedynie około 70 proc. zapotrzebowania, co prowadzi do narastających zaległości i pogłębiającego się kryzysu w wielu branżach.

- Wzrost kosztów pamięci przekłada się na podwyżki cen całych urządzeń, a w niektórych przypadkach miesięczne wzrosty sięgają kilkudziesięciu proc. Jednocześnie wydłużają się terminy dostaw, które mogą wynosić nawet kilka miesięcy. Skala problemu zmusza firmy do rewizji budżetów, harmonogramów oraz strategii zakupowych, ponieważ dotychczasowe założenia dotyczące czasu realizacji projektów przestają być aktualne.

- Zaburzenia w dostępności sprzętu mogą spowolnić rozwój dużych projektów AI i centrów danych, jednocześnie sprzyjając rozwojowi rozwiązań lokalnych, takich jak Edge AI. Firmy są zmuszone do optymalizacji wykorzystania istniejącej infrastruktury oraz bardziej elastycznego podejścia do planowania inwestycji. Jednocześnie eksperci podkreślają, że obecna sytuacja może utrzymać się co najmniej dwa lata, ponieważ zwiększenie mocy produkcyjnych w branży półprzewodników jest procesem długotrwałym i kapitałochłonnym.